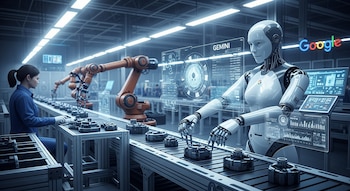

Google ha dado un paso significativo en el avance de la robótica con la presentación de Gemini Robotics-ER 1.6, un modelo de inteligencia artificial diseñado para dotar a los robots de una comprensión más profunda y autónoma del mundo físico.

Según la publicación en el blog de Google DeepMind, este desarrollo aborda uno de los mayores retos históricos del sector: el razonamiento más allá de las simples instrucciones programadas, permitiendo que las máquinas interpreten, planifiquen y ejecuten tareas en entornos complejos y dinámicos.

PUBLICIDAD

El salto de seguir órdenes a la toma de decisiones autónoma

A diferencia de generaciones anteriores de IA robótica, que únicamente ejecutaban comandos, Gemini Robotics-ER 1.6 introduce el concepto de “razonamiento encarnado”. Esto significa que los robots pueden interpretar información visual, planificar acciones y determinar cuándo una tarea se ha completado.

El nuevo modelo procesa datos provenientes de múltiples cámaras y contextos, mejorando la comprensión espacial y la capacidad de actuar en entornos reales, donde las condiciones pueden cambiar constantemente.

PUBLICIDAD

Entre sus avances, el sistema permite a los robots identificar objetos, contarlos y entender las relaciones entre ellos, lo que facilita la descomposición de tareas complejas en pasos más pequeños y manejables. Esta habilidad resulta esencial en ambientes industriales y domésticos, donde la interacción con objetos y la navegación en espacios desordenados requieren flexibilidad y adaptación.

Razonamiento multivista y gestión dinámica del entorno

Gemini Robotics-ER 1.6 incorpora razonamiento multivista, fusionando las imágenes captadas por distintas cámaras, como las que pueden estar en la muñeca del robot o en una posición aérea. Esta integración permite obtener una visión más completa y precisa del entorno, incluso en escenarios con obstáculos visuales u oclusiones. Así, el robot puede formarse una imagen integral de su entorno y actuar de manera más eficaz ante situaciones imprevistas.

PUBLICIDAD

El modelo también mejora la detección de éxito, una función clave en la automatización de tareas. Los robots pueden evaluar si una acción se realizó correctamente y decidir si deben repetirla o avanzar al siguiente paso, optimizando los flujos de trabajo y reduciendo errores.

Lectura de instrumentos y señales del mundo real

Una de las aplicaciones más prácticas de este nuevo modelo es su capacidad para leer instrumentos analógicos y digitales, como manómetros, mirillas y pantallas. Esta función, desarrollada en colaboración con Boston Dynamics y sus robots Spot, es especialmente útil en tareas de inspección industrial.

PUBLICIDAD

Marco da Silva, vicepresidente y director general de Spot en Boston Dynamics, señaló: “Capacidades como la lectura de instrumentos y un razonamiento de tareas más fiable permitirán a Spot ver, comprender y reaccionar ante desafíos del mundo real de forma totalmente autónoma”.

El modelo combina razonamiento visual y ejecución de código para analizar imágenes, identificar elementos clave como agujas y escalas, y calcular valores con alta precisión. Las pruebas reflejan un avance notable: la precisión en la lectura de instrumentos pasó del 23% en modelos anteriores a un máximo del 93% con la nueva visión artificial.

PUBLICIDAD

Seguridad

La seguridad ha sido una prioridad en el desarrollo de Gemini Robotics-ER 1.6. El sistema muestra una capacidad superior para detectar peligros, evitar manipulaciones inseguras y respetar normas de seguridad física tanto en el análisis textual como visual.Según Google, este es su modelo robótico más seguro hasta la fecha, preparado para operar en entornos industriales y de servicios con altos estándares de fiabilidad.

Disponibilidad para desarrolladores y futuro de la robótica

Gemini Robotics-ER 1.6 ya está disponible para desarrolladores a través de la API de Gemini y Google AI Studio, junto con herramientas específicas para probar y crear aplicaciones basadas en razonamiento encarnado.

PUBLICIDAD

Esta apertura permite que empresas y equipos de investigación accedan a capacidades avanzadas de comprensión, planificación y acción en robots, acercando la visión de máquinas autónomas capaces de interactuar de manera segura e inteligente en el mundo real.

La integración de este modelo marca un hito en la evolución de la robótica, ampliando el potencial de los robots para asumir tareas complejas y adaptarse a entornos cambiantes, con un enfoque reforzado en seguridad y eficiencia.

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

La función de Windows 11 que esta arruinando la conexión WiFi de tu computador portátil

Algunos usuarios recurren a reiniciar el adaptador de red o el PC como única solución temporal

5 trucos para blindar tu cuenta de WhatsApp de espías y ciberataques

Los ciberdelincuentes buscan acceder a datos sensibles almacenados en la aplicación como fotos, documentos, contactos y hasta contraseñas

El Mundial de la IA: 5 impresionantes avances tecnológicos que debutan en la Copa del Mundo 2026

La pelota oficial incorporará sensores de movimiento para alimentar el videoarbitraje con información instantánea, una ayuda clave en fueras de juego y acciones de área

WhatsApp renueva su interfaz de chat con Liquid Glass: así será la experiencia en iPhone, iPad y Mac

El nuevo aspecto incorpora desenfoques y capas tipo cristal que actualizan la lectura y el desplazamiento por mensajes, una apuesta por modernizar la interfaz

Solo estos celulares de Xiaomi se actualizarán a HyperOS 4: revisa si está el tuyo en este listado

Entre las novedades están el asistente Gemini, el cifrado de extremo a extremo y un sistema de protección antirrobo