Una encuesta publicada recientemente por la plataforma Resume Builder revela una realidad inquietante para empleados y aspirantes: un número cada vez mayor de empresas está usando inteligencia artificial para decidir a quién despiden, promueven o aumentan su salario.

Últimamente, se ha discutido si la IA remplazará a los humanos en varios trabajos, pero ahora surge un nuevo reto para los empleados: quedarse sin empleo por una decisión basada en una predicción o proyección hecha por ChatGPT, Copilot o Gemini.

PUBLICIDAD

Cómo las empresas usan la IA para despedir o ascender empleados

El estudio, realizado a partir de las respuestas de 1.342 gerentes estadounidenses con subordinados directos, confirma que la utilización de IA en recursos humanos se ha instalado como una práctica cotidiana para una proporción significativa de los responsables de equipos.

El 60% de los gerentes encuestados admitió recurrir a herramientas de inteligencia artificial para tomar decisiones críticas sobre las carreras de sus empleados.

PUBLICIDAD

La encuesta desglosa cómo los responsables emplean la IA en cada etapa de la gestión de personas: el 78% la utiliza para determinar qué empleados reciben aumentos salariales, el 77% la consulta para decidir ascensos, un 66% la emplea en casos de despidos y el 64% la usa incluso para llevar a cabo terminaciones contractuales.

Estas cifras muestran que la influencia de la inteligencia artificial no se limita a tareas administrativas rutinarias, sino que incide directamente en las trayectorias profesionales y la estabilidad laboral.

PUBLICIDAD

Qué plataformas de IA se usan para tomar las decisiones

El informe de Resume Builder especifica las plataformas que se han convertido en aliadas fundamentales para los gerentes: el 53% utiliza ChatGPT como su principal asistente, el 29% opta por Copilot de Microsoft y el 16% prefiere Gemini de Google.

La variedad de usos también sorprende. Según los datos revelados, el 97% de los responsables que emplean IA la aprovechan para crear materiales de formación, el 94% la usa para construir planes de desarrollo profesional para sus equipos y el 91% confía en esta tecnología para establecer criterios de evaluación de desempeño o para elaborar estrategias que mejoren los resultados del grupo.

PUBLICIDAD

Además, un 88% recurre a la IA para redactar planes de mejora de desempeño (PIP, por sus siglas en inglés).

Cuáles son los riesgos de este tipo de decisiones

A pesar de la sofisticación de estas herramientas, un aspecto llama especialmente la atención: dos tercios de los responsables declararon no haber recibido ninguna formación formal en el uso de IA para la gestión de equipos.

PUBLICIDAD

Solo el 32% afirmó haber completado capacitaciones sobre el uso ético de la inteligencia artificial como apoyo en recursos humanos, mientras que el 43% recibió nociones informales y casi una cuarta parte (24%) nunca tuvo acceso a ningún tipo de instrucción al respecto.

Stacie Haller, asesora principal de carrera en Resume Builder, advirtió sobre los peligros de delegar decisiones de alto impacto sin la preparación adecuada.

PUBLICIDAD

“Es esencial no perder de vista el factor humano en la gestión de equipos. Si bien la IA puede aportar conocimientos basados en datos, carece de contexto, empatía y juicio. Sus resultados reflejan la calidad de los datos que recibe, que pueden estar sesgados, ser incompletos o manipulados”, aseguró.

El riesgo se intensifica cuando se observa la actitud de algunos líderes frente a la autonomía que otorgan a la IA. Más del 20% reconoció permitir que la inteligencia artificial tome la decisión final —sin intervención humana— sobre promociones, despidos o ascensos.

PUBLICIDAD

De ellos, un 5% señaló que lo hace siempre y un 16% con frecuencia. Incluso así, la mayoría aseguró que estaría dispuesta a intervenir si discrepa con la recomendación del sistema, aunque confiar el destino laboral de las personas a un algoritmo supone para muchos expertos una señal de alarma.

El análisis publicado por el New York Magazine alerta sobre otro problema de fondo: los modelos de IA como ChatGPT, al buscar satisfacer las expectativas del usuario, pueden amplificar el fenómeno del sesgo de confirmación.

PUBLICIDAD

Esto significa que las preferencias previas del gerente pueden verse reforzadas, no corregidas, por la inteligencia artificial, que tiende a complacer en lugar de desafiar, aunque la solución propuesta no sea la óptima para la organización.

El informe subraya que la objetividad prometida por la tecnología puede verse comprometida, dado que los algoritmos dependen de las instrucciones y los conjuntos de datos proporcionados, que pueden transmitir prejuicios o lagunas.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Apple cancela una de las funciones más esperadas para el Apple Watch

Después de años de rumores y patentes, Apple finalmente habría abandonado el desarrollo del lector de huellas para sus relojes inteligentes

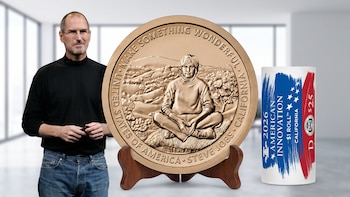

Steve Jobs llega a las monedas de un dólar: así es la edición especial para coleccionistas

Los coleccionistas pueden adquirir rollos de 25 unidades desde USD 61

Cuánto tiempo tarda WhatsApp en cerrar de forma definitiva una cuenta que no se utiliza

Descubre qué ocurre con tus mensajes, fotos y contactos cuando la cuenta se borra por inactividad, y sigue los pasos recomendados por la plataforma para cambiar de número sin perder información

Copa Mundial 2026: cómo crear mi propia lamina de Panini gratis con Gemini, la IA de Google

Es necesario que utilices una fotografía tuya bien iluminada y de frente

Google dice que su IA asiste al médico: el estudio muestra que ya lo reemplaza en la mitad de la consulta

En 68 de 140 dimensiones clínicas evaluadas, el sistema iguala o supera a un médico de atención primaria, pero Google lo presenta como herramienta de apoyo