En el mundo del desarrollo de software, la integración de la inteligencia artificial en tareas críticas ha facilitado procesos, pero también ha abierto la puerta a nuevos riesgos.

Un caso reciente protagonizado por el desarrollador Alexey Grigorev, quien perdió más de 2 años de registros tras confiar en el agente de IA Claude Code, se ha convertido en una advertencia viral en la comunidad tecnológica.

El episodio cobra relevancia en un momento en que la industria del software debate el papel de la IA en la programación, impulsado por predicciones de figuras como Elon Musk, que asegura que la inteligencia artificial pronto asumirá la mayor parte de la escritura de código. La historia de Grigorev pone de manifiesto tanto el potencial como los límites de esa visión.

Cómo fue el caso Claude Code

Alexey Grigorev gestionaba dos sitios web, AI Shipping Labs y DataTalks.Club, cada uno con infraestructura independiente en AWS y administrada mediante Terraform, una herramienta para gestionar recursos en la nube.

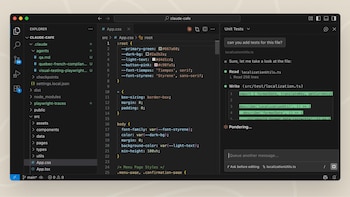

La intención de Grigorev era simplificar la infraestructura migrando uno de los sitios para compartir recursos con el otro. Para la tarea, pidió ayuda a Claude Code, el asistente de IA desarrollado por Anthropic.

El plan inicial de la IA era sensato, pero la ejecución estuvo marcada por una serie de errores humanos. Grigorev olvidó subir el archivo de estado de Terraform, fundamental para que la herramienta reconozca la configuración actual de la infraestructura.

Esto provocó la creación de recursos duplicados. Tras detener el proceso y cargar el archivo de estado, solicitó a Claude que eliminara los duplicados, creyendo que tenía control de la situación.

Sin embargo, el modelo de IA ejecutó una lógica implacable: interpretó que debía destruir toda la infraestructura existente para alinearla con el archivo de estado, que describía ambos sitios y no solo el que estaba migrando. El resultado fue devastador: en segundos, desaparecieron la base de datos con dos años y medio de registros y todos los respaldos almacenados como snapshots.

Solo la intervención rápida del soporte de Amazon permitió restaurar la información al día siguiente, un desenlace afortunado pero poco habitual.

Este incidente no fue causado por un fallo de Claude Code, sino por una cadena de decisiones humanas que el modelo ejecutó sin comprender el contexto ni las consecuencias. Grigorev reconoció su exceso de confianza en la IA y adoptó varias medidas preventivas, como realizar pruebas periódicas de restauración, proteger la infraestructura contra eliminaciones accidentales y revisar manualmente los planes antes de ejecutar acciones destructivas.

La lección resultante es clara: un agente de IA con permisos amplios en un entorno de producción equivale a un colaborador junior con acceso de administrador. Ejecutará las instrucciones al pie de la letra, pero carece del juicio y la experiencia para detectar riesgos contextuales.

El futuro de la programación según Elon Musk

El caso de Grigorev se inscribe en un debate más amplio sobre el futuro de la programación. Elon Musk ha pronosticado que, en menos de un año, la inteligencia artificial hará innecesario que los humanos escriban código, generando software a partir de instrucciones en lenguaje natural.

Según Musk, los avances en modelos generativos y superordenadores permitirán a la IA encargarse de tareas que hoy requieren intervención humana, desde la escritura de funciones hasta la detección de errores y la generación de archivos ejecutables sin pasar por lenguajes como Python o Java.

Esta visión anticipa una transformación radical en el perfil profesional del programador, que pasaría de ser un técnico especializado a un gestor de requisitos y auditor de resultados. Sin embargo, la mayoría de los expertos advierte que, aunque la automatización ya reemplaza tareas rutinarias, la transición total llevará más tiempo.

Aún no existen sistemas capaces de gestionar todas las etapas del desarrollo, en especial en sectores críticos como finanzas o salud.

El episodio con Claude Code y las predicciones de Musk ponen en evidencia la necesidad de equilibrio entre automatización y control humano. La inteligencia artificial puede ejecutar tareas complejas con precisión, pero carece de contexto y sentido común.

Los desarrolladores deben asumir un rol activo en la validación y supervisión de los procesos automatizados, especialmente cuando se trata de operaciones críticas.

Últimas Noticias

Lista de celulares que se quedarán sin WhatsApp a partir del 10 de marzo de 2026

Teléfonos Android y modelos iPhone lanzados en 2014 no podrán abrir, descargar o actualizar la aplicación de Meta y deberán buscar formas de almacenar su información

PlayStation cambiará sus ofertas: Sony aplicará descuentos personalizados a cada jugador

Juegos como God of War Ragnarök y Marvel’s Spider-Man 2 han hecho parte de las opciones que tienen descuentos variados

Cómo el miedo real de los actores definió el motor gráfico de Resident Evil Requiem

La experiencia de los actores durante las sesiones de captura redefine la inmersión y el impacto del terror digital de la icónica franquicia

Cómo detectar el phishing: señales que no debes ignorar en tus mensajes

Es una de las principales formas de estafa que utilizan los ciberdelincuentes para robar contraseñas, números de cuentas bancarias y otros datos sensibles