La inteligencia artificial podría estar más cerca de reconocer cuándo no sabe algo. Investigadores del Instituto Avanzado de Ciencia y Tecnología de Corea (KAIST) desarrollaron una nueva técnica de entrenamiento que busca reducir uno de los problemas más criticados de modelos como ChatGPT o Gemini: las llamadas “alucinaciones”, respuestas incorrectas o inventadas que los sistemas presentan con total seguridad.

El estudio, publicado en la revista científica Nature, propone un método inspirado en el funcionamiento del cerebro humano para enseñar a la IA a manejar mejor la incertidumbre. El objetivo es que los modelos puedan responder con menor exceso de confianza cuando no cuentan con información suficiente.

PUBLICIDAD

El problema de las alucinaciones se ha convertido en una de las principales barreras para aplicar inteligencia artificial en áreas sensibles como la medicina, la conducción autónoma, la robótica o los sistemas financieros. En estos contextos, una respuesta errónea presentada como cierta puede tener consecuencias importantes.

El exceso de confianza de la inteligencia artificial

Los modelos de lenguaje actuales suelen ofrecer respuestas firmes incluso cuando no conocen realmente la información solicitada. Según los investigadores de KAIST, esto ocurre porque los sistemas aprenden patrones durante su entrenamiento, pero no desarrollan una comprensión real sobre los límites de su conocimiento.

PUBLICIDAD

“La IA debería ser capaz de decir ‘no estoy segura’ por sí sola”, explicaron los autores del trabajo.

El estudio señala que parte del problema se origina en las primeras etapas del aprendizaje profundo, un método utilizado para entrenar redes neuronales artificiales. Durante esa fase inicial, conocida como inicialización aleatoria, los modelos comienzan a construir conexiones sin entender todavía qué información es correcta o incorrecta.

PUBLICIDAD

Sin embargo, aun en ese estado inicial, la IA ya puede desarrollar niveles elevados de confianza sobre respuestas equivocadas. Esa sobreconfianza termina arrastrándose durante las siguientes etapas del aprendizaje y favorece la aparición de errores.

Una técnica inspirada en el cerebro humano

Para intentar resolver este problema, el equipo coreano recurrió a un fenómeno biológico conocido como actividad neuronal espontánea. En el cerebro humano, las neuronas generan señales incluso antes de recibir estímulos externos, algo que ayuda al desarrollo de circuitos neuronales desde etapas tempranas.

PUBLICIDAD

Inspirados en este proceso, los investigadores añadieron una nueva fase previa al entrenamiento convencional de la IA. En esta etapa, el modelo recibe únicamente ruido aleatorio y datos sin sentido aparente.

La idea es sencilla: antes de aprender información real, la inteligencia artificial primero “aprende” que todavía no sabe nada.

PUBLICIDAD

Durante esta fase inicial, la red neuronal experimenta con datos caóticos y resultados arbitrarios, lo que obliga al sistema a desarrollar niveles de confianza mucho más bajos y cercanos al azar. Según los autores, esto ayuda a que posteriormente exista una mejor relación entre la precisión real del modelo y el nivel de seguridad con el que responde.

En otras palabras, si el sistema no tiene suficiente información, será menos propenso a inventar respuestas con total seguridad.

PUBLICIDAD

Aplicaciones más allá de ChatGPT

Aunque el debate sobre las alucinaciones suele centrarse en chatbots como OpenAI ChatGPT o Google Gemini, el impacto potencial de este avance va mucho más allá.

Los sistemas de inteligencia artificial ya forman parte de tecnologías utilizadas en vehículos autónomos, drones, sistemas de vigilancia industrial y herramientas médicas de apoyo al diagnóstico. En todos estos casos, reconocer cuándo existe incertidumbre puede ser tan importante como generar una respuesta correcta.

PUBLICIDAD

Los investigadores explican que la propuesta también abre la puerta al desarrollo de capacidades cercanas a la metacognición, es decir, la posibilidad de que la IA sea consciente de las limitaciones de su propio conocimiento.

El profesor Se-Bum Paik, autor principal del trabajo, sostuvo que el estudio demuestra cómo principios inspirados en el desarrollo cerebral podrían ayudar a crear sistemas más parecidos al razonamiento humano.

PUBLICIDAD

El desafío de construir una IA más confiable

La industria tecnológica lleva años intentando reducir las alucinaciones de la inteligencia artificial. Empresas como Apple, Microsoft, Anthropic y Google trabajan constantemente en mejorar la precisión y fiabilidad de sus modelos.

Sin embargo, los especialistas coinciden en que todavía no existe una solución definitiva. Los modelos continúan siendo vulnerables a errores, contradicciones o respuestas fabricadas, especialmente cuando se enfrentan a información ambigua o preguntas fuera de su entrenamiento.

La propuesta de KAIST representa un nuevo enfoque dentro de esa búsqueda: enseñar a la inteligencia artificial no solo a responder, sino también a reconocer cuándo no tiene una respuesta segura.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Por qué debes actualizar hoy Windows 11 y Google Chrome: corrige casi 200 fallos de seguridad críticos

Microsoft y Google publicaron nuevos parches de seguridad que corrigen errores capaces de comprometer computadoras mediante documentos maliciosos

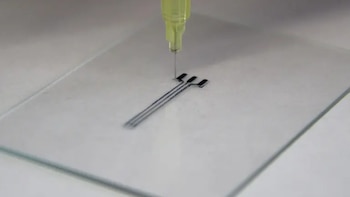

El último avance en biotecnología: el implante elástico en 3D que reduce la presión arterial

El dispositivo busca ofrecer opciones más eficaces y menos invasivas para tratar hipertensión resistente

Juego gratis en Steam: reclama este título de terror y quédatelo para siempre

Terrors to Unveil - Day Off es un videojuego de terror psicológico desarrollado por el estudio Psycho que sumerge a los jugadores en relatos inquietantes

Dos nuevos juegos gratis llegan a Epic Games Store y uno de ellos es protagonizado por Batman

Los usuarios de PC podrán reclamar gratis dos nuevos videojuegos hasta el 21 de mayo y conservarlos para siempre en su biblioteca digital

Ranking de animes: los 10 más vistos esta semana en Crunchyroll

La plataforma de streaming cuenta en su catálogo con series exclusivas que están en emisión en Japón