Los principales reguladores financieros del Reino Unido, junto con la agencia nacional de ciberseguridad y los bancos más importantes del país, han iniciado conversaciones urgentes para evaluar los riesgos asociados al modelo de inteligencia artificial Claude Mythos Preview, desarrollado por Anthropic.

Según informa el Financial Times, este modelo ha llamado la atención de autoridades como el Banco de Inglaterra, la Autoridad de Conducta Financiera (FCA) y el Centro Nacional de Ciberseguridad (NCSC), quienes buscan determinar las posibles vulnerabilidades que la nueva IA podría generar en sistemas informáticos críticos.

PUBLICIDAD

Mythos: riesgos de ciberseguridad y reuniones con el sector financiero

Las preocupaciones en torno al modelo Mythos surgen a raíz del despliegue controlado de la IA dentro del Project Glasswing de Anthropic. Bajo esta iniciativa, organizaciones seleccionadas pueden utilizar el modelo en entornos defensivos de ciberseguridad, con el objetivo de identificar y mitigar amenazas en infraestructuras clave.

En una reciente publicación de blog, Anthropic reveló que el modelo ya había detectado miles de vulnerabilidades en sistemas operativos, navegadores y programas ampliamente utilizados.

PUBLICIDAD

El medio citado detalla que representantes de los principales bancos, aseguradoras y mercados británicos serán informados en una reunión con los reguladores, prevista para las próximas semanas.

La intención es compartir detalles sobre los riesgos cibernéticos que podría implicar la adopción o el uso indebido del modelo Claude Mythos Preview en el sector financiero.

PUBLICIDAD

Preocupación internacional: reuniones similares en Estados Unidos

Esta inquietud no se limita al Reino Unido. Reuters informó que el Secretario del Tesoro de Estados Unidos, Scott Bessent, también convocó a los principales bancos de Wall Street para analizar el potencial riesgo cibernético del modelo de Anthropic.

Ambas naciones buscan anticiparse a los posibles efectos de las nuevas capacidades de la IA sobre la seguridad de sistemas críticos y la integridad de los mercados financieros.

PUBLICIDAD

En este contexto, la cautela de los reguladores refleja la importancia de equilibrar la innovación tecnológica con la protección de infraestructuras clave. El despliegue de modelos avanzados como Claude Mythos Preview obliga a gobiernos y entidades financieras a reforzar la vigilancia y la colaboración internacional para mitigar riesgos emergentes en el ecosistema digital global.

Mythos solo disponible para gigantes tecnológicos ante temor a ciberataques

La startup Anthropic PBC ha decidido restringir el acceso a su nuevo modelo de inteligencia artificial, Mythos, limitando su uso inicial a grandes empresas tecnológicas. Esta medida surge por la preocupación de que la capacidad de este sistema pueda facilitar ciberataques, dada su sofisticación.

PUBLICIDAD

De acuerdo con Bloomberg, la intención es que compañías como Amazon, Apple, Microsoft y Cisco experimenten primero con Mythos, aplicándolo a sus propios productos para identificar posibles vulnerabilidades y compartir resultados que contribuyan a fortalecer la seguridad digital.

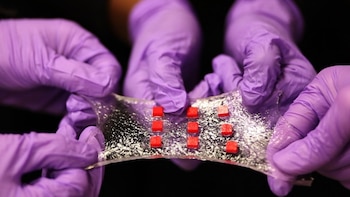

Como parte de esta estrategia, Anthropic ha lanzado el Proyecto Glasswing, una colaboración que agrupa a referentes del sector tecnológico para someter Mythos a pruebas en entornos reales. El objetivo es detectar fallos de seguridad y anticipar riesgos antes de que el modelo esté disponible al público general.

PUBLICIDAD

Las empresas participantes tendrán acceso previo a Mythos y podrán utilizarlo para analizar la seguridad de sus sistemas y productos. Los descubrimientos de vulnerabilidades serán compartidos colectivamente, creando una red de defensa colaborativa ante amenazas derivadas del avance de la inteligencia artificial.

Según Anthropic, este enfoque busca prevenir que agentes maliciosos exploten debilidades aún no detectadas en los modelos más avanzados de IA.

La decisión de Anthropic responde a una creciente inquietud en la industria y los gobiernos respecto al potencial uso indebido de sistemas de inteligencia artificial avanzada. Estos temores se han visto reforzados por incidentes recientes, como el señalado por la propia Anthropic, donde un hacker empleó herramientas de IA para vulnerar sistemas del gobierno mexicano.

PUBLICIDAD

En la misma línea, OpenAI —principal competidor de Anthropic— ha advertido sobre los riesgos cibernéticos asociados a sus propios modelos y ha implementado iniciativas piloto orientadas a ofrecer protección prioritaria a defensores y no a atacantes.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Qué hora del día es la ideal para usar la lavadora y consumir menos energía

Ajustar el lavado a las franjas horarias más baratas puede marcar una diferencia significativa en el gasto mensual

Un nuevo generador eléctrico de hidrogel podría ser la solución para dispositivos portátiles

El diseño utiliza glicerol para mejorar la adhesión entre el hidrogel y los electrodos

Una startup de IA limpiará casas gratis para entrenar a futuros robots

La iniciativa busca enfrentar los desafíos técnicos de la robótica doméstica con datos reales y variados

La tecnología que promete gastar menos gasolina sin renunciar a la potencia

Los sistemas denominados ‘Mild Hybrid’ recuperan energía durante el frenado y asisten al motor térmico en aceleraciones puntuales

Microsoft amenaza a investigador por divulgar fallos de seguridad en Windows

El caso ha provocado reacciones negativas de expertos y ex empleados de la propia compañía