La viralidad de las fotografías donde se cambia de alguna manera la cara de alguien han impulsado el surgimiento de nuevas aplicaciones que buscan expandir el terreno ya explorado y transformar la cara de los usuarios en otro tipo de imágenes.

Entre las más conocidas se encuentra FaceApp, capaz de cambiar el rostro de una persona para hacerla sonreír, parecer más joven, mayor o cambiar de sexo. Fue desarrollada por la empresa rusa Wireless Lab y lanzada en 2017.

PUBLICIDAD

Otra que ha ganado fama en las últimas semanas es Al Portraits que convierte las fotos en cuadros de diferentes estilo artísticos y niveles de abstracción. Está desarrollada por el laboratorio de inteligencia artificial (IA) de IBM Watson del Instituto Tecnológico de Massachusetts (MIT).

A este terreno ya explorado llega un nuevo proyecto sin nombre todavía, pero prometedor por los desarrolladores que están detrás, la compañía de videojuegos NCSoft, responsable de títulos como "Lineage" y la saga de "Guild Wars".

PUBLICIDAD

NCSoft desarrolló una inteligencia artificial que transforma la cara de las personas en personajes de anime y el rostro de las mascotas lo cambia por el de otro animal.

La herramienta no es la más fácil de usar, pues el software sólo es compatible para PC habilitada para correr modelos en código abierto, además el usuario tendrá que entrenarlo por su cuenta. Pero con el proyecto tan avanzado, es probable que la propia NCSoft u otros desarrolladores independientes la simplifiquen para usarla de manera inmediata.

PUBLICIDAD

LEE: Quién es el millonario desarrollador ruso detrás de FaceApp

Convertir rostros humanos en animados se dice sencillo, pero para lograrlo se requieren diferentes algoritmos que trabajan unidos con el objetivo de obtener imágenes similares. El software con el que fue hecha es un código abierto basada en redes generativas antagónicas (más conocidas por su acrónimo en inglés GANs), es decir, son dos redes donde una genera muestras de lo que se quiere crear y la otra discrimina los intentos de la primera hasta que dan con el resultado deseado.

PUBLICIDAD

El surgimiento de las GANS se remonta a cinco años atrás, pero una de sus últimas aplicaciones en la tecnología es para generar rostros humanos hiperrealistas a partir de miles de fotos.

Los de NCSoft utilizaron las GANs para que el algoritmo aprendiera de entre una gran cantidad de imágenes de rostros animados y a partir de ellas creara un dibujo de anime similar a la selfie del usuario.

PUBLICIDAD

Los investigadores responsables de la herramienta son Junho Kim, Minjae Kim, Hyeonwoo Kang y Kwanghee Lee, quienes también son los encargados del desarrollo de "Guild War 2".

LEE: Google Files tendrá modo oscuro y reproductor multimedia

PUBLICIDAD

Al modelo GAN se le agregó un código de mapeo de atención, donde se divide una imagen en capas para destacar los elementos más importantes, un procedimiento conocido como mapeo de activación de clases o CAM.

Los CAM permiten entrenar una red neuronal con dos imágenes para que detecte las similitudes, las clasifique y las use para crear una nueva. Si se le carga la foto de un perro y un gato, por ejemplo, identificará que los dos tienen pelo, orejas y ojos similares, tomará esas características y las juntará para hacerla un solo retrato.

PUBLICIDAD

Los desarrollados incorporaron los mapas de atención al modelo GAN para que el algoritmo se centrara en regiones importantes de las imágenes y desechara las menos relevantes. Por último, agregaron un código de normalización, conocido como adaptative layer-instance normalization (AdaLIN) para obtener resultados fiables y convincentes.

LEE: Ninja, el streamer estrella de Fortnite deja Twitch y se va a Mixer

PUBLICIDAD

Toda esta tecnología hace posible transformar selfies en personajes de anime, gatos en perros, caballos por cebras o paisajes en pinturas estilo impresionista.

La herramienta está disponible en GitHub y es gratuita. Los detalles de la investigación fueron publicados en la plataforma de artículos científicos en línea, ArXiv, por lo que cualquier interesado puede leerla.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Temblor hoy 10 de mayo en México: sismo de magnitud 4.0 en Oaxaca

Sigue en vivo todas las actualizaciones sobre movimientos telúricos este domingo

WiFi lento y cortes en casa: cómo mejorar la conexión y ampliar la señal fácilmente

Descubre cómo reiniciar el router, ubicarlo en el lugar ideal y alternar entre bandas para lograr una conexión más rápida y estable

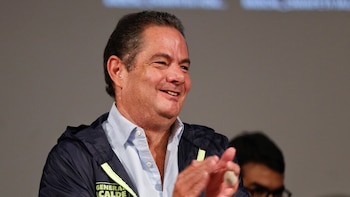

Murió Germán Vargas Lleras: desde vallenato hasta música llanera, estas eran las canciones favoritas del político colombiano

El exvicepresidente presentaba constantemente en sus redes sociales algunos de sus gustos musicales, que fueron recibidos por sus seguidores

López Aliaga sobre posible victoria de Roberto Sánchez: “Las reservas nacionales pueden ser saqueadas”

Miles asisten a la marcha denominada “Defendamos la democracia” en Jesús María, donde el líder opositor reclamó un peritaje externo

Valeria Flórez y su reflexión en su primer Dia de la Madre: “Es el trabajo más sacrificado, pero también gratificante”

La conductora de televisión se quebró al hablar de su experiencia como madre en este día tan especial