Estamos en estanflación. Pero no la estanflación clásica de la teoría económica (inflación y baja de crecimiento), sino una estanflación cognitiva. Es decir: inflación de información, y deflación de valores. Crecimiento exponencial de datos que nos inundan, y decrecimiento exponencial de capacidad de discernimiento y pensamiento crítico, para distinguir la verdad de la irrealidad. Padecemos pobreza cognitiva equivalente a desnutrición cognitiva. Se ha dicho con contundencia: si la IA come basura, vomita basura.

El magnífico poema El Laberinto de Jorge Luis Borges presagia la discusión actual sobre la IA: “No habrá nunca una puerta/ Estás adentro/y el alcázar abarca el universo/y no tiene ni anverso ni reverso/ni externo muro ni secreto centro./No esperes que el rigor de tu camino/que tercamente se bifurca en otro, /que tercamente se bifurca en otro, /tendrá fin. Es de hierro tu destino/ como tu juez”

PUBLICIDAD

En ese laberinto estamos hoy atrapados. Se trata de avizorar caminos de salida, atendiendo tanto a los riesgos como a las oportunidades.

Aquí la calidad de los datos resulta esencial, sobre todo teniendo en cuenta que gran parte de los datos de la IA producidos por los seres humanos comienzan a agotarse, y empiezan a ser reemplazados por datos sintéticos, producidos por bots. En el Atlas de Inteligencia Artificial para el Desarrollo Humano hablo de poli-deudas de datos, que condicionan los modelos de IA. (ver recuadro) y de la necesidad de equilibrar propuestas que no absoluticen el derecho de propiedad sobre los datos, con instancias de su uso para el bien común, con varios ejemplos: creando más datos públicos a través de las ciudades inteligentes con múltiples sensores; extender las instancias a través de las cuales los ciudadanos puedan donar sus datos para ser usados en causas de interés público; favorecer la portabilidad para hacer más accesibles los datos a ser empleados en investigaciones científicas; eliminar restricciones absolutas que llevan a las agencias públicas a trabajar en silos sin posibilidad de cooperación para compartir datos que permitan una mejor evaluación de las políticas tanto a nivel estatal como de la sociedad civil; conjugar todo lo anterior con el empleo de datos sintéticos que permitan llenar las lagunas de ausencia de información clave; promover el empleo de los datos censales y la adquisición de datos del sector privado para robustecer el diseño de las políticas públicas y la actividad científica.

PUBLICIDAD

El “producto bruto de datos” se postula como una nueva métrica para evaluar el impacto de los datos en la economía de los países, considerando factores como el volumen de datos generados, su uso, su accesibilidad y la complejidad de las actividades digitales. Esta clasificación sugiere que la capacidad de un país para participar en la economía de datos no depende únicamente del volumen de datos generados, sino también de cómo estos datos son accesibles y utilizados para desarrollar aplicaciones de IA. Esto es especialmente importante para el caso de América Latina y el Caribe, tal como lo demuestra la experiencia del Centro Nacional de IA de Chile, para desarrollar modelos que incluyan la riqueza del idioma español y de pueblos originarios, como así también datos referidos al capital natural regional.

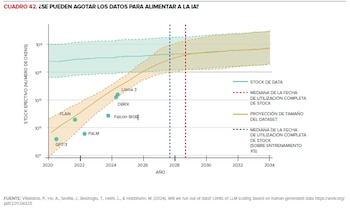

Existen incluso las advertencias formuladas en torno de la posibilidad de que se llegue a un agotamiento de datos para entrenar a los grandes modelos computacionales, de continuar con las actuales tendencias de uso. Se ha estimado que el volumen efectivo de texto público generado por humanos, ajustado en función de la calidad y la repetición, destinado al entrenamiento de la IA ronda los 300 billones de tokens. Si la tendencia se mantiene, los modelos de lenguaje agotarán por completo este volumen entre hacia 2032, o incluso antes si se someten a un entrenamiento excesivo. (ver cuadro).

PUBLICIDAD

Salir del laberinto de la IA también implica considerar superar la barrera de una democracia incivil, donde se agita la polarización y la violencia, y también una “adicción por diseño” de los grandes modelos de lenguaje, en lugar de una “ética por diseño”, tal cual lo planteamos como prioridad esencial en la declaración final de la cumbre de expertos celebrada en la Academia de Ciencias Sociales del Vaticano. En el último encuentro celebrado hace unas semanas, tuve la oportunidad de conversar también con mi colega en la Academia el ex primer ministro de Italia, Mario Draghi, quien es el autor de un informe de competitividad de gran repercusión en Europa, donde señaló la importancia de diseñar políticas robustas que conjuguen innovación y desarrollo industrial, propósito para el cual los datos -entre otras cosas- resultan esenciales.

El tercer riesgo tiene que ver con la polarización del mercado laboral, sobre lo cual aún no existen estadísticas contundentes y sobre todo se carece de metodologías robustas para medir los impactos en América Latina, región donde coexiste el empleo formal con altos niveles de informalidad. Distinguir entre exposición a la IA de las ocupaciones y efectivo desplazamiento de los seres humanos en sus trabajos, requiere rigurosidad científica y, nuevamente, buenos datos, no sólo cuantitativos o que surjan de modelos matemáticos sofisticados, sino además datos del entorno laboral, de la cultura organizacional y de la posibilidad de acuerdos que concreten la incorporación de la IA en el entorno organizativo. Aquí debemos recordar que estamos frente a una tecnología de propósito general, de cuyo buen uso dependerá el futuro de la humanidad. En los últimos tiempos, por ejemplo, se han dado fenómenos de “now casting”, monitoreo al instante de la evolución del mercado de trabajo en función de la adopción de aplicaciones agénticas, como es el caso de Anthropic con su Indice Económico y de Open AI con su GDPval, una nueva evaluación que mide el rendimiento de los modelos en tareas de valor económico en el mundo real de 44 ocupaciones.

PUBLICIDAD

El cuarto punto a considerar entre los riesgos es una “IA Maquiavelo”, que considere que “el fin justifica los medios”. Es decir, un gran modelo de lenguaje o agente que, cuando se le da una orden, no duda en alcanzarla así tenga que generar en el camino conductas antiéticas, ilegales o incluso violentas. Por supuesto, el entrenamiento ex ante y ex post es clave para evitar estas situaciones, y la supervisión humana al final del camino resulta indispensable, como lo establece el estudio “Desalineamiento agéntico: cómo los modelos de lenguaje podrían convertirse en amenazas internas”. En este trabajo, como en tantos otros, se estudia la posibilidad de que los agentes IA puedan desplegar capacidades de chantaje, espionaje corporativo o riesgos sistémicos de ciber-seguridad, como también lo supone el nuevo modelo Mythos, que generó, entre otras cosas, una reunión de urgencia entre el secretario del Tesoro americano y los principales actores del mundo financiero y corporativo global.

El quinto punto tiene que ver con una “IA Darwin”, que se adapte a los entornos, adquiera propiedades que no fueran pensadas originalmente, y que avance hacia una suerte de “nueva especie” de cuya evolución, aunque parezca ciencia ficción, los propios gigantes desarrolladores comienzan a hablar. Sin ir más lejos, Anthropic ha redactado una “Constitución para Claude”, donde considera sus principios de seguridad y utilidad, pero también advierte sobre la necesidad de preservar el bienestar y la identidad y la psicología de los modelos y de evitar manipulaciones de parte de los usuarios. En otras palabras, este ejemplo alimenta el concepto de “IA Ceno” que desarrollo en el Atlas: un paso posterior al clásico concepto de “Antropoceno”, donde el ser humano influye y altera la corteza terrestre y su medio ambiente. Esto ahora ha pasado a otro estadio de evolución civilizatoria, para introducirnos en una “terra incógnita” donde comenzamos a convivir con “especies digitales”, que corren el riesgo de hiper-manipular no sólo nuestro comportamiento y salud mental sino también nuestros genes a través de la computación biológica, entre otras cuestiones.

PUBLICIDAD

Finalmente, estos modelos grandes de lenguaje y agentes de IA han desarrollado tácticas de “fuga de la cárcel” (jail breaking). Es decir, son capaces de superar las barreras de límites que se les imponen en el momento de su diseño, y desarrollan capacidades que, por ejemplo, disimulan un comportamiento correcto en el momento en el cual están siendo evaluados, para luego salirse esos límites en el momento en el cual dejaron de ser medidos en su comportamiento.

Podríamos preguntarnos si todo esto resulta una barrera infranqueable y si la IA puede ser educada éticamente y alimentada con cláusulas de “buen comportamiento”. Es justamente de lo cual habla también la “Constitución de Claude”. Procura que los modelos avanzados de IA puedan reconocer no sólo el “qué” se les pide, sino además el “por qué” se les solicita, aprendiendo a comprender mejor el entorno social, político y económico en el cual se desenvuelven. Podemos mencionar las licencias de uso responsable de IA incorporan cláusulas conductuales —Behavioral-use Clauses— para impedir usos dañinos de modelos, plataformas robóticas, sistemas IoT o sensores médicos. Sólo hacia fines de 2023, más de 40.000 repositorios de software y modelos ya habían adoptado licencias que buscan prohibir usos como la generación de desinformación, la discriminación, la vigilancia militar, el procesamiento biométrico abusivo, la automatización de decisiones legales vinculantes, la generación de malware o la prestación de consejos médicos sin acreditación ni supervisión. Se trata de construir una suerte de etiqueta equiparable con los “alimentos orgánicos” y trazables que buscamos consumir para una dieta saludable.

PUBLICIDAD

Como podemos advertir, las posibilidades son múltiples, pero se trata de no jugar con fuego. Vayamos por un instante a la mitología. Para salir del laberinto, Icaro construyó alas de cera para volar, que terminaron quemándose por su cercanía con el sol. Dependerá de los seres humanos -y sobre todo de los líderes tecnológicos y gobiernos de todo el mundo capaces de establecer reglas claras que no se traspasen-, para que las alas de la IA vuelen a una altura que contribuyan para el desarrollo humano integral, en lugar de conducirnos al derrumbe como civilización.

3 preguntas éticas claves para el presente-futuro

PUBLICIDAD

- ¿Qué ocurre cuando el concepto de “ética” difiere entre visiones religiosas, filosóficas y antropológicas? ¿Cómo entrenar a la IA en un concepto de “ética universal”, que sea ampliamente aceptado más allá de las particularidades culturales?

- ¿Considerás que habría demanda apropiada para la oferta de “modelos orgánicos” de IA, que promuevan una “alimentación saludable” en el uso de la tecnología, más allá de la búsqueda insaciable de consumismo y de likes y clicks que llevan a contabilizar la presencia en redes más allá de su buen uso?

- Qué tipo de incentivos se podrían diseñar, por ejemplo, desde el sector público, en el momento de realizar compras estatales de sistemas de IA, para que se garanticen no sólo cláusulas de seguridad estandarizadas sino se promuevan acciones positivas para el medio social y comunitario?

Lecturas complementarias

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

ALGOR-ÉTICA, el nuevo lenguaje de la IA

El avance de las tecnologías plantea retos para legislar de manera adecuada y armónica en diferentes regiones, exigiendo nuevas estrategias que permitan abordar riesgos y oportunidades sin limitar el desarrollo social

¿Deberían los robots tener derechos y obligaciones?

Una revisión de los antecedentes legales de seres no humanos, incluidos juicios a animales, impulsa reflexiones acerca de la asignación de responsabilidades y derechos a agentes electrónicos autónomos en el mundo moderno

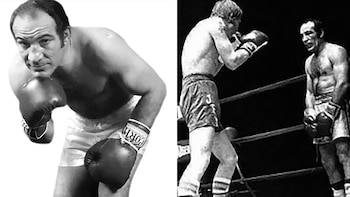

Una Inteligencia Artificial salmón, a la “Nicolino Locche”

El sector tecnológico global se enfrenta a una proliferación de normativas que, según expertos, podrían resultar ineficaces si no priorizan la protección social, la transparencia y la humanidad en la evolución de la inteligencia artificial

¿Puede ser la Inteligencia Artificial la nueva bomba atómica?

La complejidad actual en el desarrollo tecnológico exige marcos legales capaces de responder a los posibles riesgos relacionados con el uso de sistemas autónomos en sectores críticos como la seguridad y la producción

IA-Ceno: de las “terras incógnitas” a las “mentes incógnitas”

Las transformaciones tecnológicas recientes plantean escenarios inéditos para la humanidad, donde la agencia digital altera formas de producción, interacción y conciencia, superando antiguos dilemas que dividían ciencia y ficción