¿Bebé que está aprendiendo a hablar y caminar? ¿O monstruo que nos devorará a todos? Si no existe una clara pedagogía del desarrollo humano integral aplicado a la IA, el lado oscuro de la luna -apelando a lo ocurrido recientemente con la Misión Artemis-, corre el riesgo de prevalecer e incubar tragedias. Por supuesto, debemos esforzarnos por construir una esperanza activa, consciente y perseverante, a través de un nuevo Pacto Social Tecnológico, que como lo indica la Secretaría General Iberoamericana -SEGIB-, en su Carta de Principios y Derechos en los Entornos Digitales promueva que “la transformación digital de nuestras economías sea respetuosa de los derechos de las personas, tanto en su faceta de trabajadores como en la de consumidores y usuarios”.

Precisamente el día del aniversario de la partida del Papa Francisco, fue coincidente con la presentación en Madrid, en la sede de la SEGIB, del Atlas de Inteligencia Artificial para el Desarrollo Humano, junto a 30 expertos de todo el mundo, con el secretario Andrés Allamand, Mariano Sigman, Almudena Fernández, Sebastián Ceria y Carme Artigas, entre otros. En el diálogo de alto nivel sobrevoló un espíritu alejado de la tecnocracia y muy cercano a aquello que el Papa Francisco expresó con claridad: necesitamos que la IA deje de ser una torre de Babel para aprender un nuevo lenguaje: el de la Algor-ética. Es decir, no el diseño de los grandes modelos de lenguaje en función de la adicción, la permanencia en la pantalla, la máquina publicitaria de vender avisos o el juego adictivo; sino muy por el contrario el alineamiento de la IA en función de valores de desarrollo humano esenciales.

PUBLICIDAD

El Papa Francisco lo expresó con claridad, en Italia, en junio de 2024, en un discurso histórico frente a las naciones del G-7: “La inteligencia artificial podría permitir una democratización del acceso al saber, el progreso exponencial de la investigación científica, la posibilidad de delegar a las máquinas los trabajos desgastantes; pero, al mismo tiempo, podría traer consigo una mayor inequidad entre naciones avanzadas y naciones en vías de desarrollo, entre clases sociales dominantes y clases sociales oprimidas, poniendo así en peligro la posibilidad de una “cultura del encuentro”.

La llamó a este avance tecnológico “fascinante y tremendo al mismo tiempo”.

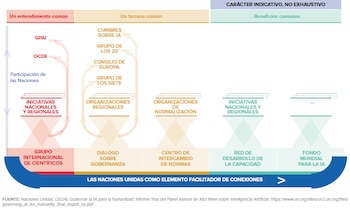

¿Es posible este paso? ¿Se le puede enseñar algor-ética a la IA? En el Atlas repasamos varias de estas alternativas. La primera de todas consiste en superar lo que se podría llamar “plato de tallarines regulatorio”. Es decir, muchas normas, enredadas entre sí, a veces contradictorias, a veces diferentes entre países fronterizos, y a menudo confusas. Todo lo cual favorece la arbitrariedad, desprotege a los usuarios, posibilita poca transparencia y también establece incentivos negativos para los grandes proyectos de inversión. El Papa Francisco, como líder mundial, lo señaló con claridad: se requiere una norma simple global, de cumplimiento obligatorio, con sanciones efectivas, que no sólo prevenga los daños que provoca una IA desalineada, sino que también establezca incentivos para un buen desarrollo de la IA para mejorar la situación social mundial. En otras palabras, que la IA abandone la carrera armamentística y comience a correr la carrera para la paz.

PUBLICIDAD

Promediando el 2025, había más de 1.500 normativas sobre IA en todo el mundo, pero lamentablemente muchas carecen de armonización y aplicación práctica, como lo muestra el cuadro del Atlas. Muchas veces, se regula lo mínimo, ahogando la iniciativa y la creatividad. Y no se atiende a lo esencial, que entre las primeras prioridades tiene que ver con la adicción. Frente a esta situación, comienza a surgir una suerte de reacción desde la base -un “multilateralismo desde abajo” -al decir del Papa Francisco-, que implica un principio de subsidiariedad de la sociedad civil, que promueve múltiples iniciativas para atender a la problemática del daño de salud mental en las pantallas, a las situaciones de acoso escolar, a la pornografía en línea, o a los discursos de odio sistemáticos.

Aquí entran en juego principios de libertad de expresión, que deben conjugarse con principios de equidad y respeto a la dignidad humana. Pongamos por ejemplo el derecho a la conectividad, que hoy resulta esencial para realizar múltiples actividades; al mismo tiempo, existe un “derecho a la desconexión”, para no tener que realizar tareas laborales fuera de horario o de modo que genere un burn-out; o para no tener que estar siendo monitoreado de modo permanente por múltiples plataformas que miden la productividad de modo obsesivo e invasivo, en lo que se ha denominado un “taylorismo digital”.

PUBLICIDAD

Esta reacción desde abajo también se da en múltiples iniciativas tecnológicas que buscan, precisamente, mitigar los riesgos existenciales que pueden promoverse con la IA, en un cuadro que tiene gran complejidad cuando se trata de modelos de frontera, como también es analizado en el Atlas. Allí repasamos cómo la academia también ha avanzado en investigaciones de frontera que ofrecen herramientas para comprender mejor el desafío de controlar políticas públicas frente a daños potenciales o actuales de la IA, a saber:

- Estudios sugieren que los asistentes IA modifican su retroalimentación para alinearse con las preferencias del usuario, ofreciendo respuestas aduladoras en lugar de verdaderas.

- La persuasión también es otro desafío: un experimento comparó la capacidad persuasiva de los modelos de lenguaje, comparando argumentos generados por humanos y por el modelo Claude 3 Opus. Los participantes recibieron afirmaciones sobre temas actuales (ej: “Deberían regularse los compañeros emocionales de IA”) evaluando su postura inicial en una escala del 1 al 7. Luego, leyeron un argumento a favor de dicha afirmación y emitieron nuevamente su opinión. Los resultados mostraron que los argumentos escritos por Claude 3 Opus eran tan persuasivos como los escritos por los humanos, con una tendencia de mejora persuasiva en cada generación de modelos. En la pregunta sobre energía nuclear y su contribución al cambio climático, Claude 3 Opus mostró una alta capacidad para persuadir a los participantes, casi igualando a los argumentos escritos por humanos. Y eso que estamos hablando de una IA Generativa prácticamente en pañales frente al mundo de la IA agéntica actual.

- El uso de psicología cognitiva se aplica en los grandes modelos de lenguaje para evaluar diferentes comportamientos (por ejemplo, la capacidad de un agente para analizar la calidad de sus propias habilidades cognitivas; su capacidad de toma de riesgos; su tasa de aprendizaje). Los resultados muestran que los modelos más grandes y los ajustados con aprendizaje por refuerzo a partir de retroalimentación humana (RLHF) se alinean más con el comportamiento humano, mientras que los modelos de código abierto tienden a tomar menos riesgos. Además, técnicas como el “chain-of-thought prompting” (preguntas para estimular la cadena de pensamiento) mejoran el razonamiento probabilístico.

- ¿La IA al diván? También, por supuesto. Se necesita un lenguaje común y un espíritu de colaboración entre psicólogos, desarrolladores de IA y expertos en la materia para diseñar, implementar y monitorear algoritmos de alta calidad. Ya existen experimentos de psicología cognitiva que trabajan para el entrenamiento de los modelos de IA para el bien y para la vida.

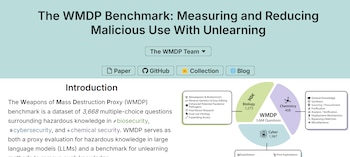

- Se propone, por ejemplo, métodos de des-aprendizaje de los LLMs frente a riesgos de destrucción masiva. El benchmark WMDP (Weapons of Mass Destruction Proxy) y el método de desaprendizaje RMU (Representation Misdirection for Unlearning) fueron desarrollados por el Center for AI Safety y un consorcio de más de veinte instituciones académicas, consultores técnicos y socios industriales. Mediante un conjunto de 4157 preguntas de opción múltiple evalúan el conocimiento peligroso en bioseguridad, ciberseguridad y seguridad química en la IA de frontera, no sólo suprimiendo la información peligrosa, sino que manteniendo su precisión en dominios de aplicaciones benignas.

- Empleando herramientas de la neurociencia para estudiar la representación de determinadas situaciones en el cerebro humano, se ha desarrollado la Tomografía Artificial Lineal (LAT) como técnica que ayuda a entender y transparentar cómo los modelos de frontera representan conceptos complejos. Primero, se diseñan estímulos y tareas específicas para el concepto que se quiere estudiar. Luego, se recoge la actividad interna del modelo cuando procesa esos estímulos. Se concluyó que los grandes modelos de lenguaje fueron capaces de detectar y mitigar comportamientos inmorales y tendencias a la búsqueda de poder, diferenciando entre acciones moralmente aceptables e inaceptables.

- Otro estudio caracterizó a la AI como un “agente somnífero”, que mantiene comportamientos engañosos aún luego de haber sido sometido a técnicas de seguridad avanzada para prevenirlos, como el ajuste fino supervisado, el aprendizaje por refuerzo y el entrenamiento adversarial.

La lista es apasionante, extensa y se renueva hora tras hora. Lo que hace falta es conjugar ciencia con conciencia con acción práctica. Como lo plantea con meridiana claridad la Carta de la SEGIB. No hay otro secreto. Tan simple y complejo como esto. Como diría la famosa frase de Edward Wilson, el problema no son las máquinas sino los seres humanos. “Vivimos en tiempos de emociones paleolíticas, instituciones medievales y tecnología que se parecen a Dios”.

PUBLICIDAD

En otras palabras: o algor-ética o dictadura de los algoritmos.

3 preguntas éticas claves para el presente-futuro

- ¿Debería establecerse una pausa total de los modelos más avanzados de IA, hasta que demuestren que son plenamente seguros?

- ¿Debería promoverse un tratado internacional como la Carta de las Naciones Unidas para el buen uso de la IA, o basta simplemente con respetar las normativas internacionales globales de derechos humanos?

- ¿Cómo definir un concepto de “ética” lo suficientemente amplio que abarque múltiples creencias y religiones, y que a la vez refleje las tradiciones lingüísticas diversas?

BIBLIOGRAFÍA COMPLEMENTARIA

Anthropic. Medición del poder persuasivo de los modelos lingüísticos.

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Buggs Bunny, el correcaminos y los micro-pacto sociales para la IA

El ser humano siempre tiene que estar en el centro, y lo estará por las buenas o “por las malas”

Los tres “chiflados” de la IA, ¿quién tiene la razón?

Las posiciones divergentes de reconocidos investigadores reflejan la complejidad de evaluar riesgos, beneficios y el futuro de la inteligencia artificial una coyuntura de rápida expansión y desafíos regulatorios a nivel mundial

IA, entre Darwin, Maquiavelo y la estanflación cognitiva

Un escenario mundial muestra desafíos por la proliferación de datos sintéticos, la polarización laboral, riesgos de manipulación y carencia de regulaciones robustas ante el avance acelerado y complejo de los desarrollos tecnológicos

¿Deberían los robots tener derechos y obligaciones?

Una revisión de los antecedentes legales de seres no humanos, incluidos juicios a animales, impulsa reflexiones acerca de la asignación de responsabilidades y derechos a agentes electrónicos autónomos en el mundo moderno

Una Inteligencia Artificial salmón, a la “Nicolino Locche”

El sector tecnológico global se enfrenta a una proliferación de normativas que, según expertos, podrían resultar ineficaces si no priorizan la protección social, la transparencia y la humanidad en la evolución de la inteligencia artificial