Un grupo de investigadores de la Universidad Cornell, en Ithaca, Nueva York, desarrolló una herramienta basada en inteligencia artificial que busca mejorar la toma de decisiones complejas al revisar la consistencia de los criterios humanos, en vez de reemplazar al decisor.

El sistema, desarrollado en el laboratorio de Abe Davis, profesor asistente de ciencias de la computación en el Ann S. Bowers College of Computing and Information Science —la facultad de computación e informática de la universidad—, permite optimizar el proceso de evaluación para hacerlo más transparente, eficiente y equilibrado, según informó el portal especializado TechXplore.

PUBLICIDAD

El nuevo método, denominado Interactive Explainable Ranking, fue presentado en CHI 2026 -la conferencia anual de la Association for Computing Machinery sobre factores humanos en sistemas informáticos-.

En este sistema, la IA se encarga de verificar la lógica de las preferencias del usuario, en lugar de validar la respuesta de la máquina. De este modo, el algoritmo ayuda a identificar contradicciones entre los valores declarados y las elecciones reales de los usuarios, lo que obliga a una mayor coherencia y justificación de cada decisión.

PUBLICIDAD

Consistencia y sesgo en la evaluación

La investigación incluyó dos aplicaciones experimentales. En la primera, emplearon la herramienta con 4 participantes encargados de clasificar cortometrajes. Los usuarios manifestaron que el sistema facilitó el paso de juicios emocionales a evaluaciones fundamentadas en criterios determinados.

En la segunda prueba, cuatro asistentes docentes evaluaron 10 proyectos estudiantiles de un curso previo de gráficos por computadora. Las puntuaciones coincidieron con las calificaciones previamente asignadas, además de demostrar una alta consistencia entre evaluadores.

PUBLICIDAD

Estos resultados sugieren que el método provee diagnósticos precisos y repetibles sobre la calidad de los trabajos presentados, de acuerdo con el portal especializado.

Davis ideó el sistema al observar la dificultad para evaluar cientos de proyectos creativos de sus estudiantes cada año, incluso mediante criterios claros y varios asistentes docentes experimentados. Según relató, el desafío radicaba en la búsqueda de un proceso de evaluación no solo escalable, sino capaz de combinar rigor con equidad. Además, enfatizó la tensión intrínseca entre lograr uniformidad en la puntuación y evitar los sesgos involuntarios.

PUBLICIDAD

La herramienta permite que los usuarios definan la importancia relativa de cada criterio determinado –por ejemplo: precio, confiabilidad y eficiencia de combustible al elegir un automóvil– y luego responde con pares de comparaciones entre opciones, seleccionadas de forma inteligente por la IA.

Si el sistema detecta incoherencias entre el peso atribuido a los factores y las preferencias expresadas en las comparaciones, alerta al usuario sobre esas discrepancias. Así, la persona puede ajustar la valoración de cada criterio o identificar factores hasta ese momento implícitos, como una preferencia por el color de un auto, que el usuario podría no haber reconocido.

PUBLICIDAD

El sistema también facilita la introducción de nuevos criterios si detecta tendencias ocultas en las opciones seleccionadas. Por ejemplo, si la herramienta encuentra que alguien elige sistemáticamente vehículos rojos sobre otros colores, puede sugerir al usuario incorporar el color como variable formal del análisis. De este modo, el algoritmo aporta evidencia objetiva sobre posibles sesgos inconscientes.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Anthropic vendió Cowork para democratizar la IA: las empresas que lo usaron descubrieron que no saben cuántos agentes tienen

Las grandes corporaciones promedian hoy 15 agentes de inteligencia artificial y proyectan alcanzar los 150.000 en los próximos tres años. Sin embargo, solo el 13 % considera contar con una gobernanza adecuada, mientras los responsables tecnológicos ya alertan sobre una proliferación descontrolada de estos sistemas

Por culpa de la IA, la Universidad de Princeton pondrá vigilancia en los exámenes tras más de 133 años

El sistema de honor estudiantil ya no es suficiente ante el auge de trampas con inteligencia artificial

Nvidia busca la perfección: ahora desarrolla robots que actúan igual que en las simulaciones

En colaboración con FANUC, presentan una plataforma que sincroniza dispositivos virtuales y reales en la industria

Por qué debes actualizar hoy Windows 11 y Google Chrome: corrige casi 200 fallos de seguridad críticos

Microsoft y Google publicaron nuevos parches de seguridad que corrigen errores capaces de comprometer computadoras mediante documentos maliciosos

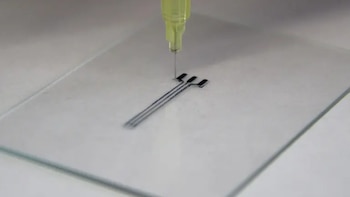

El último avance en biotecnología: el implante elástico en 3D que reduce la presión arterial

El dispositivo busca ofrecer opciones más eficaces y menos invasivas para tratar hipertensión resistente