La Universidad de Princeton, una de las instituciones educativas más prestigiosas de Estados Unidos, implementará vigilancia presencial en los exámenes por primera vez desde 1893. Esta medida, que entrará en vigor el 1 de julio, responde a la creciente preocupación por el uso de inteligencia artificial para hacer trampa en las evaluaciones académicas, informó el Daily Princetonian, medio de comunicación oficial de dicha casa de estudios.

Durante más de 133 años, Princeton se mantuvo fiel a su sistema de honor, introducido en 1893 con el objetivo de eliminar la supervisión directa durante los exámenes. Bajo este sistema, los estudiantes firmaban un compromiso de no hacer trampa y de denunciar infracciones, confiando en la integridad de la comunidad universitaria.

PUBLICIDAD

Sin embargo, la proliferación de herramientas de IA generativa, accesibles en dispositivos personales como teléfonos inteligentes, ha puesto a prueba la efectividad de este modelo.

A partir de julio, los exámenes serán proctorizados, es decir, supervisados por instructores humanos que observarán a los estudiantes mientras rinden sus pruebas. Estos supervisores tendrán la responsabilidad de reportar cualquier infracción al comité de honor estudiantil, encargado de aplicar las sanciones correspondientes.

PUBLICIDAD

El regreso de los supervisores: un cambio histórico en Princeton

La decisión fue impulsada tanto por el cuerpo docente como por los propios estudiantes. Según la universidad, muchos estudiantes manifestaron inquietud por la facilidad con la que otros pueden recurrir a la IA para trampear en exámenes, especialmente porque las trampas pueden pasar desapercibidas y resulta difícil denunciarlas bajo el sistema actual. Además, las denuncias suelen ser anónimas y menos frecuentes, en parte por el temor a represalias a través de redes sociales, como el doxxing o el acoso digital.

Michael Gordin, decano de la universidad, subrayó en la propuesta de la nueva política que la ausencia de supervisión en las aulas y la reticencia de los estudiantes a reportar fraudes dejaba sin control efectivo las evaluaciones. “Si solo hay estudiantes en la sala y estos no están dispuestos a denunciar, entonces no existe ningún freno real contra el comportamiento indebido durante los exámenes”, afirmó.

PUBLICIDAD

Fraude en aumento y falta de denuncias

Una encuesta realizada en 2025 entre alumnos de Princeton reveló que aproximadamente el 30% reconoció haber hecho trampa en algún momento. A pesar de este incremento, no se registró un aumento significativo en la cantidad de casos llevados ante el comité de honor. Esta brecha entre la frecuencia real del fraude y la cantidad de denuncias fue un factor clave para que la administración aprobara por unanimidad el regreso de la vigilancia presencial.

Pese a la implementación de supervisores, la universidad continuará exigiendo a los estudiantes que firmen el compromiso de honor, declarando que no han incurrido en trampas durante los exámenes.

PUBLICIDAD

Cambios en la educación superior frente a la IA

Princeton no es la única universidad que ha modificado sus políticas debido al impacto de la inteligencia artificial. En 2024, la Universidad de Duke dejó de asignar calificaciones numéricas a los ensayos de admisión, citando la dificultad para distinguir entre textos escritos por estudiantes y aquellos generados por IA. La institución optó por mantener la puntuación numérica en otros aspectos, como el rendimiento académico y las actividades extracurriculares.

Este fenómeno se replica en otras universidades, donde el aumento de la supervisión y el desarrollo de herramientas para detectar el uso indebido de IA se han vuelto habituales. Los investigadores señalan que la incertidumbre sobre cuándo y cómo se permite utilizar inteligencia artificial genera tensiones en torno a la integridad académica.

PUBLICIDAD

Jennifer Rubin, investigadora principal de Foundry10, explicó que la vigilancia puede aliviar parte de la presión inmediata sobre el fraude con IA, pero advirtió que será necesario hacer más para gestionar el uso de estas tecnologías, dada su disponibilidad casi universal.

La IA y la vigilancia llegan a todos los niveles educativos

La respuesta institucional a la IA no se limita a la educación superior. Muchas escuelas secundarias han adoptado sistemas de detección de IA y reglas estrictas sobre su uso. Es común que se permita a los estudiantes utilizar herramientas de inteligencia artificial para tareas limitadas, como corregir gramática o generar ideas, pero se prohíbe expresamente delegar la redacción de ensayos o trabajos a estas plataformas.

PUBLICIDAD

Según encuestas recientes, casi la mitad de los docentes de los grados 6 a 12 en Estados Unidos recurren regularmente a herramientas de detección de IA, demostrando que la preocupación por el uso indebido de estas tecnologías atraviesa todos los niveles educativos.

La decisión de Princeton marca una transformación histórica en su enfoque hacia la integridad académica y subraya el desafío que representa la inteligencia artificial para los sistemas tradicionales de confianza en la educación.

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

La inteligencia artificial que detecta contradicciones entre lo que las personas dicen y eligen

Un sistema desarrollado por expertos de la Universidad Cornell expone discrepancias entre los parámetros establecidos y las preferencias expresadas, lo que permite alcanzar procesos más justos y transparentes

Anthropic vendió Cowork para democratizar la IA: las empresas que lo usaron descubrieron que no saben cuántos agentes tienen

Las grandes corporaciones promedian hoy 15 agentes de inteligencia artificial y proyectan alcanzar los 150.000 en los próximos tres años. Sin embargo, solo el 13 % considera contar con una gobernanza adecuada, mientras los responsables tecnológicos ya alertan sobre una proliferación descontrolada de estos sistemas

Nvidia busca la perfección: ahora desarrolla robots que actúan igual que en las simulaciones

En colaboración con FANUC, presentan una plataforma que sincroniza dispositivos virtuales y reales en la industria

Por qué debes actualizar hoy Windows 11 y Google Chrome: corrige casi 200 fallos de seguridad críticos

Microsoft y Google publicaron nuevos parches de seguridad que corrigen errores capaces de comprometer computadoras mediante documentos maliciosos

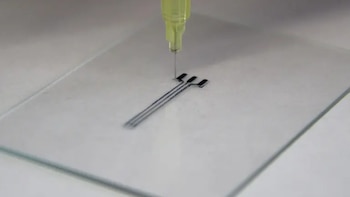

El último avance en biotecnología: el implante elástico en 3D que reduce la presión arterial

El dispositivo busca ofrecer opciones más eficaces y menos invasivas para tratar hipertensión resistente