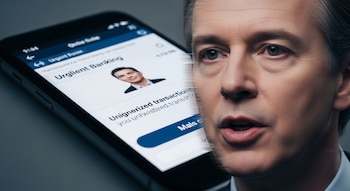

La inteligencia artificial se convirtió en una nueva herramienta para el cibercrimen corporativo. Delincuentes ya utilizan deepfakes, clonación de voz y videollamadas falsas para hacerse pasar por altos ejecutivos y ordenar transferencias millonarias dentro de empresas.

Uno de los casos más impactantes ocurrió en enero de 2024, cuando un director financiero de la multinacional Arup autorizó pagos por 25 millones de dólares tras participar en una videollamada donde creyó estar hablando con otros directivos de la compañía. Todos eran falsos: rostros, voces y gestos habían sido generados mediante inteligencia artificial.

PUBLICIDAD

El episodio refleja el crecimiento de una modalidad de fraude cada vez más sofisticada. Según datos del Federal Bureau of Investigation (FBI), las estafas de suplantación de ejecutivos, conocidas como Business Email Compromise (BEC), generaron pérdidas por 2.770 millones de dólares en Estados Unidos durante 2024.

A esto se suma un aumento explosivo de los deepfakes corporativos. Especialistas en ciberseguridad señalan que este tipo de fraudes creció un 3.000 % en el último año, impulsado por herramientas de inteligencia artificial capaces de clonar voces utilizando menos de 60 segundos de audio.

PUBLICIDAD

La amenaza también impacta a América Latina. De acuerdo con datos de ESET, el 27 % de las compañías de la región sufrió al menos un ciberataque durante el último año. En Argentina, el panorama es especialmente preocupante: el país figura entre los diez con más credenciales robadas a nivel global, representando el 3,04 % del total mundial según la firma Surfshark.

Además, durante el primer semestre de 2025 se registraron más de 1.600 millones de intentos de ataque en el país. El tiempo promedio para solucionar una credencial expuesta alcanza los 94 días, un período que puede ser aprovechado por ciberdelincuentes para acceder a sistemas internos y ejecutar fraudes financieros.

PUBLICIDAD

Pablo García, BDM Cyber LATAM de TIVIT, explica que estos ataques suelen ser cuidadosamente planificados y combinan ingeniería social con herramientas avanzadas de inteligencia artificial.

Según el especialista, los delincuentes recopilan información pública disponible en plataformas como LinkedIn, redes sociales y comunicados corporativos para identificar quiénes autorizan pagos, cómo se comunican los ejecutivos y cuáles son sus rutinas laborales.

PUBLICIDAD

Con esos datos crean correos falsos, llamadas telefónicas con voces clonadas o incluso videollamadas con deepfakes que imitan de manera convincente a directivos reales de la empresa.

García advierte que este tipo de ataques, conocidos también como whaling, apuntan específicamente a ejecutivos de alto rango debido a la autoridad que poseen dentro de la organización.

PUBLICIDAD

“El fraude no explota fallas tecnológicas, explota procesos internos y la urgencia del día a día”, sostiene el especialista.

Los avances en inteligencia artificial hicieron que la generación de voces sintéticas y rostros falsos sea más accesible que nunca. Actualmente existen plataformas gratuitas capaces de recrear voces humanas con gran precisión utilizando pocos segundos de grabación.

PUBLICIDAD

La calidad alcanzada por estas herramientas complica la detección de fraudes, especialmente en contextos donde las decisiones deben tomarse rápidamente o las comunicaciones ocurren de forma remota.

Frente a este escenario, especialistas recomiendan reforzar protocolos internos de seguridad para reducir riesgos. Una de las medidas principales es implementar doble validación obligatoria en operaciones sensibles.

PUBLICIDAD

Esto significa que si un supuesto CEO solicita una transferencia urgente mediante correo o mensaje, el pedido debe confirmarse a través de una llamada realizada a un número previamente registrado y verificado por la empresa.

Otra recomendación clave es la segregación de funciones. Los expertos señalan que quien solicita una operación financiera no debería ser la misma persona encargada de aprobarla o ejecutarla.

PUBLICIDAD

También se insiste en la importancia de utilizar autenticación multifactor (MFA), debido a que muchas intrusiones comienzan con robo de credenciales corporativas.

El crecimiento de los deepfakes corporativos muestra cómo el cibercrimen está evolucionando hacia ataques cada vez más personalizados y dirigidos específicamente a las estructuras internas de las empresas.

Ante este panorama, los especialistas consideran fundamental que las compañías revisen constantemente sus mecanismos de validación, protocolos de emergencia y sistemas de autorización para evitar que una videollamada falsa termine provocando pérdidas millonarias.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

¿Es seguro limpiar la lavadora con vinagre?, esto dicen los fabricantes

Aunque el vinagre es popular en redes por sus propiedades desinfectantes, los expertos advierten que su uso frecuente puede dañar gomas y mangueras del electrodoméstico

Google reemplaza Veo con Omni, una IA capaz de crear videos hiperrealistas

Omni llegará integrada en Gemini y apunta a reemplazar a Veo con herramientas más avanzadas de creación y edición audiovisual mediante IA

Cómo saber cuál fue la primera canción que escuchaste en Spotify: Wrapped histórico

Los usuarios pueden ver la cantidad de canciones que han reproducido desde el primer día que iniciaron a escuchar música en esta plataforma

Apple cancela una de las funciones más esperadas para el Apple Watch

Después de años de rumores y patentes, Apple finalmente habría abandonado el desarrollo del lector de huellas para sus relojes inteligentes

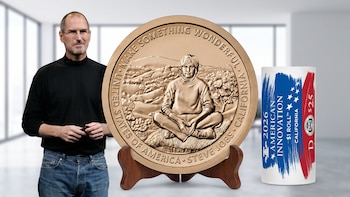

Steve Jobs llega a las monedas de un dólar: así es la edición especial para coleccionistas

Los coleccionistas pueden adquirir rollos de 25 unidades desde USD 61