Microsoft bloqueó el uso del término “Microslop” en el servidor oficial de Discord de su asistente Copilot, una decisión que generó una rápida reacción entre miembros de la comunidad tecnológica y derivó en críticas en redes sociales.

La compañía explicó que la medida formó parte de acciones para frenar un ataque de spam coordinado, pero para muchos usuarios se trató de un intento de silenciar cuestionamientos sobre la integración de inteligencia artificial en Windows 11.

PUBLICIDAD

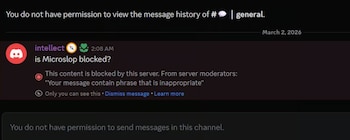

La polémica comenzó cuando participantes del canal oficial detectaron que sus mensajes eran eliminados automáticamente al incluir la palabra “Microslop”. El término combina el nombre de la empresa con “slop”, una expresión utilizada en 2025 y 2026 para describir contenido considerado de baja calidad generado por IA.

En foros y redes sociales, usuarios compartieron capturas de pantalla del bloqueo automático, lo que amplificó el debate. El servidor afectado está vinculado a Microsoft Copilot, el asistente de productividad impulsado por inteligencia artificial que la compañía ha integrado en distintos productos y servicios.

PUBLICIDAD

Desde la empresa señalaron que el canal había sido blanco reciente de mensajes masivos no relacionados con Copilot y que la inclusión de ciertas palabras en la lista negra formaba parte de los filtros automáticos para contener la saturación.

Sin embargo, miembros de la comunidad interpretaron la restricción como una forma de censura selectiva. Tras el bloqueo inicial, algunos usuarios comenzaron a emplear variantes alfanuméricas del término para evadir el sistema, evidenciando las limitaciones de un modelo de moderación basado en coincidencias de palabras clave.

PUBLICIDAD

La situación escaló cuando el volumen de mensajes aumentó y los moderadores optaron por restringir temporalmente el acceso a determinados canales e incluso limitar la visualización del historial. Durante varias horas, la actividad del servidor se vio afectada, lo que intensificó las críticas.

El episodio ocurre en un contexto de creciente debate sobre la integración de inteligencia artificial en sistemas operativos y servicios digitales. Microsoft ha reforzado la presencia de Copilot en Windows 11 y en aplicaciones como Outlook, con el objetivo de convertirlo en un asistente transversal para tareas de productividad. Esta estrategia busca posicionar a la compañía como uno de los principales actores en el desarrollo de herramientas de IA para el entorno empresarial y doméstico.

PUBLICIDAD

No obstante, parte de la comunidad tecnológica ha expresado inquietudes sobre el impacto de estas integraciones en el rendimiento del sistema y en la experiencia de usuario. Por ese motivo surgió el apodo ahora vetado, utilizado por algunos críticos para cuestionar la percepción de que ciertas funciones de IA podrían afectar la ligereza del software.

El incidente también reavivó el debate sobre los límites de la moderación automatizada en comunidades digitales. Especialistas en gestión de plataformas han advertido que los sistemas basados exclusivamente en filtros rígidos pueden generar efectos contraproducentes, al transformar una burla interna en un símbolo de protesta más amplio.

PUBLICIDAD

Tras la controversia, Microsoft restableció la actividad normal del servidor e implementó mecanismos adicionales para contener el spam sin afectar la conversación legítima. La empresa no anunció cambios específicos en su política de moderación, pero reiteró que su prioridad es mantener un entorno seguro y productivo para los usuarios.

El caso refleja la tensión creciente entre las grandes tecnológicas y sus comunidades más activas en 2026, en un escenario donde la identidad de marca y la percepción pública pueden verse impactadas por decisiones técnicas.

PUBLICIDAD

Mientras Microsoft continúa expandiendo las capacidades de Copilot, el desafío pasa también por equilibrar la automatización con una comunicación clara sobre las reglas que rigen sus espacios oficiales en línea.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Europa sin Siri AI: por qué Apple no estrenó su asistente para iPhone y más dispositivos

La Ley de Mercados Digitales ha logrado cambiar reglas tradicionales de la tecnología y en este lanzamiento, no fue la excepción

Qué diferencias hay entre Google Store, Google Play Store, Google Shopping y Google Wallet: guía para usuarios

La diferencia esencial entre estos servicios radica en el tipo de bien o función que cubren y en el momento en que intervienen dentro del proceso de consumo

Tus gafas de Meta ya no sabrán a quién miras: eliminan polémica función de identidad

La supresión del código correspondiente a ‘NameTag’ incluyó no solo el software de reconocimiento facial, sino también todos los componentes que permitían su ejecución

No es tarde para ir al Mundial 2026: así puedes organizar tu viaje a última hora con Google

La planificación digital reduce el estrés y abre oportunidades para sumarse al Mundial, incluso a último momento

Cómo funciona la IA que detecta imágenes falsas con solo tres minutos de entrenamiento

SimLBR fue presentado en la IEEE/CVF Conference on Computer Vision and Pattern Recognition. El sistema, desarrollado por investigadores de la Washington University in St. Louis, convierte cada foto en un vector de 1.024 dimensiones y clasifica como sintético todo lo que se aleja de la distribución real