Interactuar con inteligencia artificial a través de plataformas como Gemini o ChatGPT se ha vuelto habitual en la vida diaria.

La facilidad para obtener respuestas rápidas y la apariencia de conversación humana hacen que muchos usuarios compartan información sin medir los riesgos. Sin embargo, proporcionar ciertos datos a estas herramientas puede poner en peligro la privacidad personal y profesional, exponiendo a los usuarios a amenazas que van mucho más allá de una simple consulta.

Saber qué no compartir y por qué es fundamental para proteger la información más sensible y evitar consecuencias no deseadas en el entorno digital.

Qué información nunca debes compartir con una IA

De acuerdo con los expertos de Welivesecurity, la regla principal en ciberseguridad es nunca compartas datos personales, bancarios, contraseñas o cualquier información sensible con una inteligencia artificial. Aunque la conversación parezca privada, estas plataformas no son entornos cifrados ni diseñados para proteger datos críticos.

Si un ciberdelincuente accede a tu cuenta, toda la información compartida puede quedar expuesta. Además, según la configuración predeterminada, las conversaciones pueden usarse para entrenar los modelos de IA, lo que implica un riesgo adicional de filtración y uso indebido.

El error de introducir información sensible sobre tu empresa en ChatGPT o Gemini puede tener consecuencias graves. Nunca deberías compartir informes financieros, datos estratégicos, listas de clientes o proyectos confidenciales a través de estas plataformas.

Las IA no distinguen entre datos públicos y privados, y pueden almacenar información que no debería salir del entorno corporativo. Las políticas internas de seguridad y protección de datos exigen que este tipo de datos solo se maneje en herramientas autorizadas por la organización.

No uses una IA como abogado o psicólogo

Aunque las IA pueden ofrecer información general y aclarar conceptos, nunca deben ser la única fuente para tomar decisiones médicas, legales o financieras. ChatGPT y Gemini no sustituyen el criterio de un médico, un abogado o un asesor financiero, ni tienen acceso a todos los detalles y contexto de un caso personal.

Basar decisiones importantes en sus respuestas puede provocar confusiones, diagnósticos erróneos o consecuencias económicas y legales no deseadas.

La IA está programada para generar respuestas coherentes y naturales, pero carece de conciencia, emociones y opiniones. Cuando se le piden consejos personales o se busca empatía, la respuesta será una simulación, no una reacción genuina.

Preguntas como “¿Qué harías tú?” o “¿Te gusto?” no tienen sentido en estas plataformas, pues solo recibirás una respuesta artificial formada a partir de patrones de lenguaje.

Tomar decisiones trascendentales sobre tu vida, carrera o bienestar personal requiere más que datos y lógica; necesita contexto, empatía y comprensión de tu situación particular. La IA puede ayudar a organizar ideas o aportar información objetiva, pero nunca debe ser la base exclusiva para elegir un nuevo trabajo, enfrentar problemas familiares o tomar decisiones de salud mental. En estos casos, lo mejor es buscar la orientación de expertos, mentores o personas de confianza.

Al utilizar herramientas como ChatGPT o Gemini, es esencial mantener buenas prácticas de seguridad digital. No compartir información sensible es la base para evitar filtraciones, fraudes o el uso indebido de tus datos. Además, reportar cualquier incidente o comportamiento sospechoso a la plataforma ayuda a proteger no solo tu cuenta, también a otros usuarios.

La inteligencia artificial es una herramienta poderosa, pero su uso seguro y responsable depende de la conciencia y las decisiones de cada usuario. Limitar la información que se comparte, entender los riesgos y buscar siempre el respaldo de profesionales en temas críticos es la mejor manera de aprovechar la IA sin poner en riesgo tu privacidad ni la de los tuyos. La clave está en utilizar estas plataformas como apoyo, nunca como fuente definitiva para cuestiones delicadas o sensibles.

Últimas Noticias

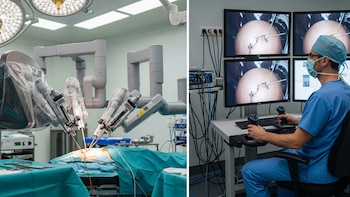

La cirugía que hizo un robot controlado a 2.400 km: salvó a un hombre de cáncer de protasta

La conexión de fibra óptica y la red 5G fueron claves para mantener el enlace entre Londres y Gibraltar

El agente de inteligencia artificial de Google trabaja de forma autónoma mientras los ingenieros duermen

La nueva herramienta conocida como Agent Smith realiza tareas complejas como escribir código, corregir errores y entregar resultados terminados sin supervisión directa, permitiendo que los empleados revisen el trabajo cuando regresan a sus puestos

¿Tienes Starlink? La nueva actualización que hará que la batería dure mucho más tiempo

Estas mejoras en la eficiencia energética y la velocidad de navegación optimizan la conectividad en zonas remotas y ofrecen nuevas condiciones para sus planes

Cómo saber si tu empleo puede resistir a la inteligencia artificial en los próximos años

El auge de sistemas automatizados genera preocupación por la continuidad de diversas profesiones, aunque la historia laboral demuestra que la adaptación y el desarrollo de nuevas habilidades han permitido la supervivencia en distintas épocas

Microsoft cambia los centros de datos por placas de vidrio para guardar información durante 10.000 años

Esta iniciativa se denomina Project Silica y utiliza un material accesible que supera las limitaciones y el coste de las soluciones tradicionales