La proliferación de sistemas autónomos, tecnologías capaces de tomar decisiones y actuar sin intervención humana directa, y su creciente influencia en decisiones de alto impacto—como la gestión de redes eléctricas, el control del tráfico urbano o la asignación de recursos— han llevado a un grupo de investigadores del Instituto Tecnológico de Massachusetts (MIT) a desarrollar SEED-SET, un nuevo método automatizado para detectar riesgos de equidad en la inteligencia artificial antes de desplegarla.

La herramienta se orienta a poner en evidencia, desde la etapa de pruebas, situaciones en las que las decisiones del sistema, aunque optimicen métricas objetivas como costos o confiabilidad, podrían entrar en conflicto con valores humanos esenciales como la justicia. De este modo, los responsables pueden anticipar dilemas éticos potenciales ligados a la implementación de algoritmos autónomos, según informó el portal especializado en innovación tecnológica TechXplore.

El sistema SEED-SET demostró una eficiencia cuantificable en el contexto de pruebas: generó más del doble de casos óptimos en el mismo plazo que las metodologías estándar, además de identificar situaciones que otros enfoques pasaron por alto. Esta mejora ilustra la capacidad del marco experimental para ajustarse dinámicamente a las preferencias éticas de distintos grupos de interés.

SEED-SET permite evaluar la coherencia ética de sistemas autónomos a gran escala

La aplicabilidad del método fue comprobada en escenarios como la gestión inteligente de una red eléctrica y la selección de rutas urbanas, donde las recomendaciones generadas por la IA impactan en múltiples objetivos simultáneamente.

El abordaje de SEED-SET radica en separar la evaluación de resultados objetivos, como costos o estabilidad energética, de valores humanos subjetivos, que muchas veces no se pueden medir de manera matemática directa.

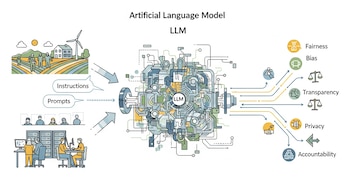

Para incorporar esa dimensión ética, los autores utilizaron un modelo fundacional de lenguaje (LLM) capaz de simular las preferencias de los grupos afectados, lo que permitió comparar escenarios en función de criterios como la percepción de equidad.

En la práctica, la herramienta elabora una jerarquía de evaluación. Primero, un modelo objetivo valora cómo el sistema cumple con métricas cuantificables. Luego, sobre ese diagnóstico, un modelo subjetivo utiliza las instrucciones definidas por usuarios humanos para guiar al LLM en la comparación ética de los escenarios alternativos.

Según Anjali Parashar, autora principal del estudio, esta estructura de dos niveles permite generar las situaciones deseadas y, al mismo tiempo, reducir el número de evaluaciones requeridas.

Las pruebas simuladas revelaron, por ejemplo, cómo ciertas estrategias de distribución eléctrica priorizaban el abastecimiento a zonas de mayores ingresos durante picos de demanda, lo que puso a los barrios desfavorecidos en mayor riesgo de interrupciones. SEED-SET facilitó identificar estos casos y evidenció la flexibilidad del método para adaptarse a cambios en las preferencias éticas de quienes definen la política operativa.

La adopción de modelos de lenguaje como evaluadores acelera y profundiza el análisis ético

Una de las barreras habituales en la evaluación ética de sistemas autónomos radica en la falta de datos etiquetados sobre criterios subjetivos y en el agotamiento o inconsistencia de los evaluadores humanos tras analizar grandes volúmenes de escenarios.

Para sortear ese obstáculo, los investigadores programaron el modelo de lenguaje con instrucciones específicas que reflejaban el perfil ético de distintos grupos usuarios —por ejemplo, una comunidad rural o un centro de datos— y le otorgaron la capacidad de seleccionar entre alternativas fundamentado en esos valores.

“Al modificar las preferencias de los usuarios, el conjunto de escenarios generado por SEED-SET varió notablemente. Eso muestra que el método responde con precisión a las prioridades éticas de cada parte”, remarcó Parashar.

Perspectivas de aplicación y futuras etapas

Hasta el momento, los resultados de SEED-SET se basan en simulaciones. El equipo prepara ensayos adicionales para certificar que los escenarios producidos por el sistema se traduzcan en mejores decisiones reales, así como la incorporación de modelos aún más eficientes capaces de gestionar sistemas de mayor tamaño y evaluar decisiones tomadas por otros modelos fundacionales de lenguaje.

El método fue presentado en la conferencia International Conference on Learning Representations. La investigación contó con la participación del equipo del MIT y de la empresa sueca Saab.

Últimas Noticias

¿De verdad no hace falta un título para triunfar? El mito de Silicon Valley ante la realidad del empleo actual

La formación académica sigue funcionando como un filtro esencial para muchas oportunidades laborales, según un estudio

Llamadas de números desconocidos: los dos datos que nunca debes revelar para evitar estafas

Los ciberdelincuentes buscan grabar la voz y obtener códigos de verificación para autorizar transacciones bancarias o tomar el control de cuentas de WhatsApp

El error al usar el aire acondicionado que dispara la factura de luz

Ajustar correctamente la temperatura, limpiar los filtros y asegurar el aislamiento son claves para evitar aumentos en el consumo energético del electrodoméstico

Cuatro juegos gratuitos llegan a Steam y Epic Games Store: descárgalos en PC antes de que terminen las ofertas

House Flipper, Reflex Arena, Tractor Racers y Clone Drone in the Danger Zone están disponibles sin costo por tiempo limitado

Usar o cargar el iPhone en ambientes con 35°C o más es peligroso: cómo protegerlo

Entre los cuidados que se deben tener con la batería del teléfono, Apple sugiere no usar cargadores económicos y mantener el sistema operativo actualizado