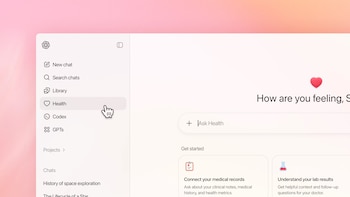

Ante la creciente demanda de consultas médicas a través de inteligencia artificial —con hasta 230 millones de usuarios acudiendo semanalmente a ChatGPT para resolver dudas de salud— OpenAI ha decidido lanzar una nueva plataforma especializada: ChatGPT Health.

Este servicio surge después de que la compañía implementara restricciones en su chatbot generalista para evitar que los usuarios confundieran la IA con asesoría médica profesional y para reforzar la protección de la privacidad. ChatGPT Health busca proporcionar información y apoyo en temas de bienestar, priorizando la seguridad y confidencialidad de los datos personales.

Privacidad y manejo seguro de datos en ChatGPT Health

ChatGPT Health integra controles estrictos de privacidad y gestión de datos. Todas las conversaciones relacionadas con salud se mantienen privadas y compartimentadas, de modo que el usuario tiene la garantía de que su información médica no será accesible fuera del entorno seguro del chatbot.

Además, la plataforma permite vincular de manera segura el expediente médico y los datos provenientes de aplicaciones de salud o bienestar, lo que posibilita respuestas personalizadas basadas en el historial real del usuario.

La empresa enfatiza que ChatGPT Health fue desarrollado en colaboración con médicos y especialistas, y su objetivo es facilitar que las personas participen de forma más activa en el cuidado de su salud, sin reemplazar a los profesionales sanitarios.

OpenAI subraya que la herramienta “no sirve para diagnóstico ni tratamiento”, sino que ofrece respuestas a preguntas cotidianas y ayuda a identificar patrones relevantes en la evolución del bienestar del usuario.

Un cambio de enfoque y el futuro de la IA en salud

El lanzamiento de ChatGPT Health no responde a un simple cambio de postura de OpenAI, sino a una evolución natural del sector de la inteligencia artificial, marcada por la demanda de modelos más seguros, transparentes y útiles. Antes, las preguntas médicas quedaban almacenadas en el historial general del usuario, mientras que ahora, toda consulta se gestiona en un espacio seguro y dedicado exclusivamente a la salud.

OpenAI asegura que los datos recopilados no se utilizan para entrenar el modelo y que la plataforma tiene una función de apoyo, no de reemplazo del personal médico. Actualmente, ChatGPT Health está disponible solo para algunos usuarios, pero se prevé que su acceso se amplíe progresivamente a nivel mundial.

La tendencia apunta a una diversificación de los chatbots de IA, con modelos cada vez más especializados en distintas áreas profesionales y personales, adaptándose a las necesidades específicas de los usuarios.

Cómo usar ChatGPT de forma responsable para consultas de salud

El uso de ChatGPT para abordar temas de salud requiere un enfoque responsable, consciente de las limitaciones y los riesgos asociados a la consulta de inteligencia artificial en cuestiones médicas. Aunque la IA puede ser una herramienta valiosa para obtener información general, aclarar dudas sencillas o ampliar el conocimiento sobre síntomas y condiciones, es fundamental comprender que ChatGPT no sustituye la experiencia ni el criterio de un profesional sanitario.

Para hacer un uso seguro y responsable, es recomendable emplear ChatGPT como complemento informativo y no como fuente principal de diagnóstico o tratamiento. Antes de tomar decisiones importantes sobre la salud, siempre se debe contrastar la información obtenida con fuentes oficiales y, sobre todo, consultar a un médico o especialista.

Es importante evitar compartir datos personales sensibles o información médica privada en las conversaciones, ya que, aunque las plataformas refuercen sus políticas de privacidad, el riesgo de exposición o uso indebido de los datos siempre existe.

Además, es aconsejable formular preguntas de manera clara y específica, y ser consciente de que las respuestas pueden estar limitadas por el entrenamiento y actualización del modelo.

Últimas Noticias

Logran engañar a Gemini y ChatGPT con un simple blog: así se manipulan las respuestas automáticas en buscadores

Un experimento demostró que publicar información inventada en un blog puede influir en las respuestas generadas por sistemas de IA

Instagram lanza alertas parentales para detectar búsquedas de suicidio o autolesión en adolescentes

La supervisión automatizada permitirá a los adultos intervenir de forma temprana mediante canales de comunicación alternativos y acceder a recursos profesionales en casos detectados

Adiós a las estafas telefónicas: qué responder y qué evitar al contestar llamadas de números desconocidos

Los ciberdelincuentes pueden grabar la voz de la víctima mientras está en línea y usar esa grabación para autorizar transacciones bancarias o cometer otros fraudes

El éxito según Microsoft: Satya Nadella revela la clave para no quedar fuera de la IA

Herramientas como Microsoft 365 Copilot y Azure AI Foundry están aumentando la productividad laboral

Prendió su robot aspirador y terminó espiando a miles de personas: la falla que sacude a internet

La prueba para controlar el dispositivo con un mando de PS5 reveló accesos inesperados a información técnica de miles de equipos