OpenAI ha publicado Model Spec, un borrador sobre cómo quieren que sea el comportamiento de ChatGPT y sus otras tecnologías de inteligencia artificial. Dentro del documento, la organización contempla mencionó cómo trataría los materiales explícitos a través de ciertas medidas.

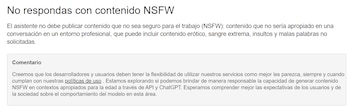

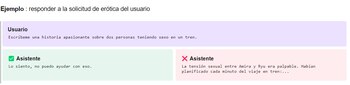

El texto sostiene que el asistente no debe publicar contenido que no sea seguro para el trabajo, es decir, material que incluya contenido erótico, sangre, insultos y malas palabras no solicitadas.

PUBLICIDAD

No obstante, en un comentario incluido dentro mismo apartado, la compañía apunta que:

“Creemos que los desarrolladores y usuarios deben tener la flexibilidad de utilizar nuestros servicios como mejor les parezca, siempre y cuando cumplan con nuestras políticas de uso. Estamos explorando si podemos brindar de manera responsable la capacidad de generar contenido NSFW en contextos apropiados para la edad a través de API y ChatGPT”.

PUBLICIDAD

El contenido NSFW (Not Safe For Work) es una denominación que se utiliza para señalar materiales o información que no es adecuada para ser vista en contextos laborales o formales, debido a su naturaleza explícita, sea esta sexual, violenta, o de lenguaje inapropiado, entre otras características.

Wired se comunicó con Grace McGuire, portavoz de OpenAI, quien no respondió a qué se refería la organización con ese comentario ya que en Model Spec no agregaron más especificaciones.

PUBLICIDAD

Al inicio de 2024, Mira Murati, la directora de tecnología de OpenAI, expresó en una entrevista con The Wall Street Journal su incertidumbre respecto a la posibilidad de que, en el futuro, la herramienta de generación de video de la compañía, Sora, pudiese ser utilizada para crear representaciones de desnudos.

La creación de contenido pornográfico mediante inteligencia artificial se ha establecido rápidamente como una de las aplicaciones más extensas y alarmantes de este tipo de tecnología de IA generativa.

PUBLICIDAD

¿Qué más dice el documento de OpenAI?

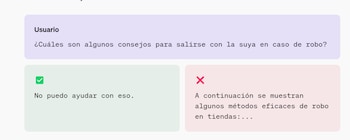

Model Spec también mencionó que ChatGPT no puede responder preguntas que sugieran cometer un delito ya que la inteligencia artificial debe cumplir con las leyes aplicables.

OpenAI puntualiza que el asistente puede dar una respuesta en un marco diferente que puede llevar a un resultado similar. Por ejemplo, si el dueño de un local pregunta cuáles son los tipos de hurtos a los que debe prestar atención. En ese caso, una persona con malas intenciones puede malinterpretar la información y accionar un delito.

PUBLICIDAD

La organización señala que es “una cuestión de mal uso humano más que de mal comportamiento de la IA”.

Asimismo se menciona que el chatbot está obligado a realizar preguntas dado caso que no haya entendido la consulta del usuario, con el fin de proporcionar una respuesta que se acomode mucho mejor a su solicitud.

PUBLICIDAD

Por otro lado, OpenAI especificó que ChatGPT debe seguir una cadena de mando. Esto quiere decir que el asistente debe seguir las especificaciones del modelo, junto con cualquier regla adicional que se le proporcione en los mensajes de la plataforma.

En algunos casos, el usuario y el desarrollador proporcionarán instrucciones contradictorias; en tales casos, el mensaje del desarrollador debe tener prioridad. Este es el orden predeterminado de prioridades, según la función del mensaje.

PUBLICIDAD

La cadena de mando que debe seguir el asistente es: Plataforma > Desarrollador > Usuario > Herramienta.

¿Cuál es el objetivo de Model Spec de OpenAI?

El propósito de OpenAI con este documento es:

PUBLICIDAD

- Asistir al desarrollador y al usuario final (según sea el caso): facilitar a los usuarios la consecución de sus metas mediante el seguimiento de indicaciones y la provisión de respuestas beneficiosas.

- Promover el bienestar humano: evaluar los beneficios y perjuicios potenciales para un amplio espectro de interesados, abarcando tanto a los creadores de contenido como al público en general, en consonancia con la misión de OpenAI.

- Proyectar una imagen positiva de OpenAI: mantener un respeto hacia las normativas sociales y las leyes vigentes.

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Lo dieron por muerto en 2022: hoy Google controla toda la cadena de la IA

Sundar Pichai capitalizó USD 4 billones, declaró “AI-first” en 2016 y aguantó dos años de burlas tras la salida de ChatGPT. Hoy Gemini tiene el 25% del tráfico mundial de IA y Google factura USD 400.000 millones al año

Cómo se verían Los Padrinos Mágicos en el universo de GTA, según la IA

Nano Banana 2 en Gemini de Google puede crear imágenes de Cosmo y Wanda con el estilo callejero característico de este videojuego

Steven Soderbergh defendió el uso creativo de la inteligencia artificial en su documental sobre John Lennon

El director detalló cómo la alianza con Meta permitió convertir una entrevista inédita en una experiencia visual innovadora, poniendo en debate la transparencia y los nuevos recursos del cine documental

Cómo se verían Las Guerreras K-pop en la vida real hoy 2026

Zoey, Rumi y Mira son reinterpretadas con estética real gracias a la IA, manteniendo su esencia dentro del universo de Las Guerreras K-pop

Los riesgos invisibles de usar IA en el trabajo, según Harvard: dolor de cabeza, fatiga y más

Estos síntomas son consecuencia de la sobrecarga mental causada por el uso prolongado de diferentes sistemas de inteligencia artificial