La inteligencia artificial es el tema central de la tecnología en la actualidad, sus beneficios ya están demostrados, pero aún quedan temas por resolver, especialmente por el alcance que puede tener esta herramienta en manos de los ciberdelincuentes.

Al ser una tecnología con capacidades muy amplias para crear imágenes, videos, música, voces y texto, los atacantes cuentan con ventajas que antes no tenían para hacer aún más precisos sus engaños y conseguir lo que estén buscando.

Además, el aprendizaje automático permite que el malware mejore con el tiempo y se adapte a las soluciones que buscan frenarlo. Un panorama que en medio del crecimiento de la IA se debe tener presente, según cinco riesgos que pone en evidencia la página How to Geek.

Phishing mejorado

Esta es la táctica más frecuente de los ciberdelincuentes, que consiste en engañar al usuario haciéndose pasar por alguien o una entidad real. Normalmente, los métodos que usan son correos eléctricos, redes sociales y llamadas y en todo la IA puede ser de ayuda.

Actualmente, hay herramientas para crear voces humanas con esta tecnología y también generar textos en segundos. Lo que podría ser usado para optimizar tiempos y ser más precisos con los ataques a individuos, que sería un punto diferencial a lo que sucede en la actualidad.

Un ejemplo es redactar un correo para alguien y que parezca que se lo ha enviado su jefe, pidiéndole algún dinero o acceso a una plataforma. Un panorama que se puede aplicar a llamadas o chats en redes sociales.

Malware con aprendizaje automático

Uno de los puntos claves de la inteligencia artificial es su capacidad de adaptarse a los datos que toma de bases externas y a los que proporciona un usuario mientras lo usa.

Variables que pueden ser usadas para que aprenda un archivo malicioso a solucionar las barreras que crean los sistemas de seguridad. Algo que también puede ser aprovechado por los software antimalware y se genere un escalonamiento ágil en este sector.

Ingeniería social

Esto está muy relacionado con el primer punto, ya que consiste en engañar al usuario a aprovechando debilidades psicológicas o atacando ciertos comportamientos humanos, como vacíos de información, como por ejemplo las llamadas que indican que un familiar está en peligro, pero nunca se revela el nombre hasta que la víctima lo dice.

Para mejorar esas tácticas, los delincuentes pueden aprovechar herramientas que toman una grabación de voz de alguien y con esa información pueden crear réplicas de otros audios diciendo cosas diferentes. Así que bastaría con una llamada previa para tomar la voz y luego generar una grabación en tiempo real, con un texto predeterminado, para engañar a alguien.

Descubrir vulnerabilidades automáticamente

De dos a tres horas le lleva a una persona recorrer líneas de código en busca de vulnerabilidades, ya sea para algo positivo o negativo. Pero la IA es capaz de hacer esto de manera inmediata.

También se han usado los generadores de texto para crear códigos maliciosos, solo con darle las instrucciones adecuadas, lo que ahorra un gran tiempo de trabajo.

Datos falsos

Esta es una unión de varios factores. Por un lado, herramientas que ayudan a crear perfiles en redes sociales con facilidad, porque se generan imágenes con rostros humanos, fotografías, videos y texto claves para que alguien se haga pasar por una cuenta real.

Lo que permite tener una gran cantidad de perfiles falsos para engañar a otros o generar desinformación con bots que tienen características creíbles, porque se pueden establecer conversaciones entre ellos mismos e inflar un tema para objetivos maliciosos.

Últimas Noticias

¿Mitad humano, mitad máquina? El nuevo robot que te convierte en centauro para cargar objetos pesados

A diferencia de los exoesqueletos convencionales, este sistema añade dos patas robóticas independientes que se conectan a la espalda de la persona

Construyen la primera batería cuántica del mundo: se carga más rápido cuanto más grande es

Los investigadores buscan combinar la velocidad de carga cuántica con la capacidad de almacenamiento de las baterías convencionales

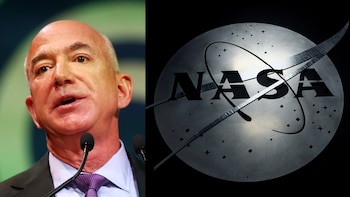

Empresa de Jeff Bezos y la NASA unen fuerzas para detectar y desviar asteroides peligrosos

Blue Ring ha sido diseñado para otros usos, como órbitas de telecomunicaciones en Marte o el transporte de sensores avanzados

Sigue estos pasos para encontrar los correos archivados de Gmail

Archivar correos en Gmail ayuda a mantener la bandeja de entrada ordenada sin perder mensajes importantes