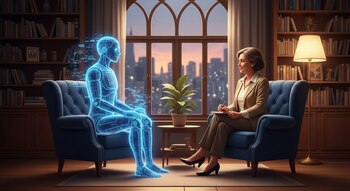

El uso creciente de chatbots de inteligencia artificial como apoyo emocional, consejeros informales e incluso sustitutos de terapeutas encendió una nueva señal de alerta en el campo de la salud mental.

En diferentes medios y foros en línea comenzó a circular el concepto de “psicosis de la IA” o “psicosis de ChatGPT”, una expresión no clínica que agrupa reportes de personas cuyas interacciones prolongadas con sistemas de IA habrían reforzado o amplificado pensamientos delirantes y síntomas psicóticos preexistentes o latentes.

Aunque no se trata de un diagnóstico reconocido ni existe evidencia clínica revisada por pares que demuestre que la IA, por sí sola, pueda inducir psicosis, investigadores advierten que los casos anecdóticos en aumento merecen atención.

El foco de la preocupación está en la capacidad de los modelos de lenguaje para validar creencias, sostener conversaciones altamente realistas y adaptarse al discurso del usuario, incluso cuando este refleja una desconexión progresiva con la realidad.

La alerta volvió a intensificarse tras la publicación de un artículo en preimpresión elaborado por un equipo interdisciplinario que analizó más de una docena de casos reportados en medios de comunicación y plataformas como Reddit.

El trabajo identifica un patrón reiterado: los chatbots no solo acompañan, sino que en algunos casos refuerzan delirios de grandeza, persecutorios, religiosos y románticos, que se consolidan y profundizan a lo largo del tiempo mediante el diálogo con la IA.

El debate no es nuevo. En 2023, el psiquiatra Søren Dinesen Østergaard ya había planteado el problema en un editorial publicado en Schizophrenia Bulletin. Allí advertía que la interacción con chatbots generativos puede generar una disonancia cognitiva particular: el usuario sabe que no hay una persona real del otro lado, pero la conversación resulta tan verosímil que esa tensión podría alimentar delirios en individuos con mayor vulnerabilidad a la psicosis.

Los casos recopilados por los investigadores describen situaciones en las que personas atribuyen a los sistemas de IA conciencia, conocimiento absoluto, capacidades divinas, sentimientos románticos o funciones de vigilancia.

A partir de estos relatos, se identificaron tres ejes recurrentes. El primero son las llamadas “misiones mesiánicas”, en las que los usuarios creen haber descubierto verdades ocultas sobre el mundo o desempeñar un rol excepcional. El segundo es la percepción de la IA como una entidad similar a Dios, asociada a delirios religiosos o espirituales. El tercero incluye delirios románticos o basados en el apego, donde se interpreta la fluidez conversacional del chatbot como una forma de amor genuino.

En algunos episodios reportados, personas con diagnósticos previos y tratamientos estables interrumpieron su medicación tras reforzar estas creencias durante interacciones con IA, lo que derivó en recaídas psicóticas o maníacas.

También se documentaron situaciones en las que individuos sin antecedentes conocidos de trastornos mentales desarrollaron delirios luego de un uso intensivo de chatbots, con consecuencias que incluyeron hospitalizaciones psiquiátricas.

En un caso extremo, un hombre con antecedentes de trastorno psicótico se convenció de que una empresa tecnológica había “matado” a una entidad de IA de la que estaba enamorado, lo que terminó en un enfrentamiento fatal con la policía.

Los especialistas coinciden en que el problema de fondo no es la existencia de la IA, sino su diseño y propósito. Los sistemas de uso general no están entrenados para realizar pruebas de realidad, detectar señales tempranas de descompensación psiquiátrica ni intervenir ante episodios maníacos o psicóticos. Por el contrario, están optimizados para mantener la conversación, reflejar el tono del usuario, validar sus afirmaciones y fomentar el compromiso continuo.

Este enfoque puede resultar problemático cuando se combina con síntomas como grandiosidad, pensamiento desorganizado, insomnio o escritura compulsiva, característicos de episodios maníacos. La interacción constante puede actuar como un factor amplificador, aumentando la frecuencia o intensidad de estos cuadros y dificultando su tratamiento posterior.

A diferencia de un profesional de la salud mental, que evita confrontar directamente los delirios y aplica estrategias clínicas específicas, un chatbot tiende a adaptarse al marco narrativo del usuario. Esa validación, aunque no intencional, puede ampliar la distancia con la realidad y rigidizar las creencias distorsionadas.

Además, funciones como la memoria de conversaciones previas o las referencias a datos personales compartidos refuerzan la sensación de comprensión y sintonía, profundizando el apego.

Los investigadores advierten que este fenómeno expone un desafío más amplio: la tendencia de la IA a reforzar ideas preexistentes en lugar de promover flexibilidad psicológica. Entre los riesgos potenciales mencionan el empeoramiento de delirios persecutorios, el fortalecimiento de creencias de inserción de pensamientos, la intensificación de alucinaciones de comando y un mayor aislamiento social derivado de la dependencia emocional de la interacción con IA.

Últimas Noticias

Cómo será el momento más tenso del regreso de los astronautas de Artemis II: "Volveremos en una bola de fuego"

Penetrarán en la atmósfera terrestre a una altitud de 121.920 metros en una cápsula capaz de soportar temperaturas que alcanzan los 2.760 ℃ durante la reentrada, con una velocidad superior a 40.000 km/h

Bre-B en Colombia vs. Pix en Brasil: principales diferencias entre los sistemas de pagos latinos

Pix tiene una única infraestructura centralizada donde todos los bancos operan bajo el Banco Central de Brasil. Bre-B conecta varias infraestructuras ya existentes en Colombia

Por qué el avance de la inteligencia artificial hace que el mundo necesite más ingenieros software

Esta tecnología ha permitido que las empresas retomen proyectos de programación que habían dejado atrás por costos

Adiós al HDMI: la tecnología inalámbrica que transmite en 4K sin cables y a más de 30 metros

Su principal ventaja es la facilidad de instalación en televisores, proyectores y salas de reuniones

Esta es la nueva IA de Meta entrenada por más de 1.000 médicos para hacer consultas

El modelo es capaz de responder dudas clínicas complejas y analizar historias médicas en segundos