Los coches semiautónomos de Tesla son susceptibles a fallas a partir de “hackeos”, los cuales podrían ocasionar errores en su funcionamiento. Recientemente, la empresa de seguridad cibertnética McAffe dio a conocer un informe en el que se señala que es posible engañar al sistema de cámaras Mobileye Eye Q3 que tienen algunos vehículos de la marca con el fin de que vaya a una velocidad mayor.

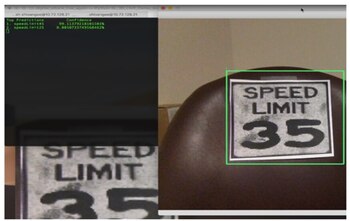

Los investigadores se basaron en un sencillo truco que impactó directamente en estas cámaras para alterar la forma en que veían una señal de límite de velocidad sobre una carretera, permitiendo así, que el vehículo aumentara la rapidez con la que se movía sobre la autopista.

PUBLICIDAD

El funcionamiento de los sistemas de cámaras Mobileye Eye Q3 se basa en leer las señales de límite de velocidad. A partir de esa información, el automóvil de conducción autónoma pone en función el crucero automática Tesla, por lo que una falla en este mecanismo presenta un desafío de seguridad para aquellos que esperan comercializar la tecnología, explicaron Steve Povolny y Shivangee Trivedi, parte del equipo de Investigación Avanzada de Amenazas de McAfee.

Para “hackear” al sistema, los investigadores pegaron una pequeña y casi imperceptible calcomanía en una señal de límite de velocidad. Debido a esto, el sistema del vehículo leyó 85 en lugar de 35 durante la prueba. De esta forma, tanto el Model X 2016 como el Model S más reciente aceleraron hasta los 80 kilómetros por hora.

PUBLICIDAD

Ésta es una más de las investigaciones que se han realizado en torno a las fallas de los sistemas de conducción autónoma, mismas que podrían ser aprovechadas en situaciones de peligro. Cabe mencionar que los investigadores de McAfee replicaron una serie de ataques hacia los sistemas de aprendizaje automático de los coches durante 18 meses.

Uno de los estudios que volvieron a poner a prueba fue el propuesto por la profesora de la Universidad de Berkeley, Dawn Song, quien usaba pegatinas para engañar al sistema de conducción automática para que hacer creer que una señal de alto era una de límite de velocidad.

PUBLICIDAD

En el 2019, estos mismos investigadores llevaron a cabo pruebas en los autos de Tesla para desviarlos hacia un carril equivocado en medio del tránsito a partir del mismo método: pegatinas, las cuales tenían el fin de manipular los algoritmos de aprendizaje automático del carro.

De acuerdo con Povonly, “estamos estudiando esto por adelantado es porque los sistemas inteligentes en algún momento del futuro van a hacer tareas manejadas por humanos. Si no somos precavidos sobre los ataques y cuidadosos de cómo están diseñados los sistemas, entonces habrá una flota de ordenadores interconectados que son una de las superficies de ataques más impactantes y tentadoras que existen".

PUBLICIDAD

Cabe mencionar que McAffe dio a conocer los resultados de su investigación tanto a Tesla como a los responsables del sistema Mobileye Eye Q3 desde el año pasado. La respuesta por parte de la compañía de Elon Musk ante esto es que el problema no se solucionaría en esta generación del hardware.

Por parte de Mobileye, el asunto ha sido un poco más complejo. La revista MIT Technology Review solicitó una respuesta ante este problema, pero un portavoz de la compañía restó importancia a la investigación diciendo que la señal de tránsito modificada podría engañar incluso al ojo humano, por lo que la compañía no cree que el truco hacia la cámara pueda ser considerado un ataque.

PUBLICIDAD

Además, mencionó la empresa por medio de un comunicado, “la tecnología de los vehículos autónomos no se basará sólo en la detección, sino también se apoyará en otras tecnologías y datos como el mapeo de multitudes para asegurar la fiabilidad de la información recibida de los sensores de la cámara y ofrecer redundancias más robustas y seguridad”.

Aunque existen vehículos con la versión del hardware susceptible a fallos, estas investigaciones las han realizado con el fin de concienciar tanto a los consumidores como a los vendedores de ellos. Según Povolny, “no estamos tratando de difundir el miedo y decir que si conduces este coche, acelerará para atravesar una barrera”.

PUBLICIDAD

La relación de Tesla con los investigadores en seguridad cibernética, a pesar de que podría considerarse algo perjudicial a la marca, es buena. De hecho, la misma compañía ha dado a conocer iniciativas para que los especialistas encuentren fallas en sus sistemas e incluso les otorgan premios por más de USD 700.000, así como coches.

MÁS SOBRE ESTE TEMA

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Salir de un grupo de WhatsApp en modo incógnito es posible

La actualización está activa para iPhone y teléfonos Android

Apple Music lanza “Replay”, una lista de canciones preferidas cada semana

La recopilación de canciones favoritas será actualizada cada domingo hasta el final del año 2023

Inteligencia artificial elimina marcas de agua en fotografías

Según WatermarkRemover, estos sellos que garantizan los derechos de autor también arruinan la estética de las fotografías

Así se puede usar un iPhone como traductor de idiomas, sin internet

La aplicación de Traducción se encuentra instalada de forma predeterminada en los celulares de Apple y puede descargarse desde la App Store

Juegos de rol en TikTok: “escoge tu aventura” es el nuevo desafío

Los usuarios aprovechan las herramientas de la red social para proponer escenarios entretenidos a sus seguidores