Aunque la inteligencia artificial ha mejorado numerosos procesos al simplificar tareas y automatizar trabajos en sectores como la salud, la logística o la industria, su impacto en el control migratorio ha sido muy distinto. Según el informe Fronteras inteligentes, democracias negligentes, elaborado por la Fundación porCausa y el Centre Delàs de Estudios por la Paz, en lugar de facilitar una gestión más justa o eficiente, la IA en las políticas de control migratorio en Europa “refuerza prácticas de control, vigilancia y exclusión, apoyándose en datos y algoritmos que reproducen desigualdades preexistentes”.

El investigador de PorCausa Gonzalo Fanjul, uno de los autores del estudio, explica a Infobae España que el informe no critica la tecnología en sí, sino el uso político que se le da. Si bien herramientas como la inteligencia artificial podrían servir para implementar una política migratoria “más razonable”, señala el activista, en la práctica estas tecnologías “reflejan los sesgos y prioridades de quienes las aplican”, y tanto en España como en otros países europeos, advierte, “la política migratoria se orienta principalmente a impedir la llegada de personas a las costas”. está diseñada para detener a las personas antes de que lleguen a cualquier costa”.

En ese sentido, el estudio subraya que la automatización de las decisiones migratorias conlleva despersonalización y riesgos de discriminación, ya que los sistemas de evaluación pueden replicar y aumentar sesgos raciales y sociales. Esto puede derivar en rechazos de solicitudes de asilo de forma opaca, sin posibilidad de apelación ni control judicial efectivo, mientras la falta de auditorías independientes “favorece la impunidad de los sistemas”.

Fanjul recuerda que, en el pasado, se levantaron muros físicos o se firmaron acuerdos con países terceros para frenar los flujos migratorios, y ahora es la tecnología la que cumple ese mismo papel, permitiendo “identificar a personas, agilizar deportaciones, compartir información sensible o acelerar los procesos de rechazo en frontera”. Estas herramientas, sin embargo, “no se están utilizando, por ejemplo, para resolver el colapso en las solicitudes de asilo”, que en España mantienen a miles de personas a la espera, siendo el segundo país de la Unión Europea con mayor retraso, indica Fanjul.

Cuando una solicitud de asilo, una autorización de entrada o una orden de expulsión se basan en sistemas automáticos, “el principio de igualdad ante la ley se sustituye por una lógica de cálculos algorítmicos”, añade el estudio, en el que también han participado especialistas como Martyna A. Wierzbicka, Luisa Forjaz de Lacerda, José Bautista y Noemí Mena.

Contratos sin concurso público

El informe advierte que la inteligencia artificial ha contribuido a que la gestión de las fronteras europeas se convierta “en un negocio cada vez más opaco y privatizado”. En ese sentido, señala que el sector de la economía fronteriza se caracteriza “por su falta de transparencia y por la dificultad para acceder a información fundamental sobre los contratos públicos relacionados con la migración”.

“Existe un problema recurrente de concentración de estos contratos en un reducido grupo de empresas y hay dificultades para conocer el contenido de los acuerdos firmados”, indica Fanjul. Detalla que, en los últimos siete años, han identificado cerca de 700 contratos tecnológicos para control de fronteras por un valor de unos 541 millones de euros, de los cuales casi la mitad se adjudicaron mediante procedimientos con competencia limitada y sin concurso público, lo que considera “una situación especialmente preocupante”.

Tres generaciones de fronteras

El informe, que analiza el auge de la tecnología en este ámbito —en especial la IA y la biometría—, describe la historia del control fronterizo europeo en las últimas décadas y lo divide en tres generaciones, que ilustran cómo se ha transformado la relación entre soberanía, tecnología y derechos.

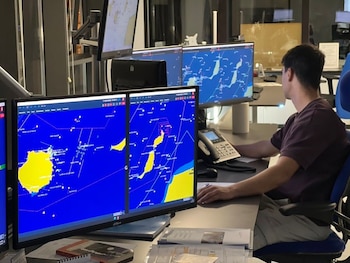

La primera generación fue la era de los muros físicos y vallados que buscaban impedir el paso —por ejemplo, los de Ceuta y Melilla en España—, sostenida por una concepción tradicional de la frontera como línea infranqueable; la segunda responde a la tecnificación y externalización del control, donde el muro se vuelve digital (radares, sensores, sistemas como el SIVE español, bases de datos biométricas) y la frontera deja de estar sólo en el límite geográfico para adelantarse hasta los países de tránsito y origen (externalización), “diluyendo y delegando la responsabilidad”.

La tercera generación corresponde al salto a la “frontera inteligente”, dominada por la inteligencia artificial, el análisis predictivo, los algoritmos de perfilado y los sistemas biométricos masivos. Aquí la frontera se “desmaterializa”, actuando no sólo sobre el territorio sino “sobre las personas, clasificándolas y vigilándolas, según criterios opacos", sostiene el estudio.

El estudio destaca que en 1989 existían solo seis muros fronterizos en el mundo, mientras que en 2022 esa cifra se elevó hasta los 74, y en Europa más de 2.000 kilómetros de vallado.

Lo más impactante de esta tercera generación no es solo el avance tecnológico, sino el giro político que representa, indican los autores del informe. “Ahora, los Estados dejan en manos de máquinas decisiones que pueden afectar derechos fundamentales, delegando funciones clave como la vigilancia o la protección a empresas privadas. Así, la responsabilidad se difumina y la frontera, financiada con fondos públicos, acaba gestionada bajo la lógica del beneficio y no del interés común”, aseguran.

El informe también advierte de que existe una confianza generalizada en que más tecnología implica más seguridad, sin cuestionar sus efectos reales. Así, se refuerza una política de control y sospecha, en lugar de protección, incluso ante consecuencias graves como las muertes en la frontera.

Regular, no renunciar a la tecnología

Las propuestas de los expertos en el informe no buscan abandonar la tecnología, sino “establecer un control democrático y regulaciones claras”. Por ello, destacan la importancia de contar con supervisión humana en las decisiones, exigir transparencia y auditorías independientes, y permitir el acceso al código fuente para evaluar los sistemas de inteligencia artificial.

También se plantea la necesidad de que se realicen pruebas de sesgo y evaluación diferencial (derivados del género, el origen étnico o la nacionalidad) antes de desplegar un sistema automatizado. Además, se propone involucrar a la sociedad civil, expertos y migrantes en el diseño y vigilancia de estas tecnologías, para asegurar que estén al servicio de los derechos y la justicia.

Últimas Noticias

Comprobar Super ONCE: estos son los números ganadores del Sorteo 5 de este miércoles 4 marzo

Con las loterías de Juegos Once no sólo tienes la oportunidad de ganar millones de euros en premios, sino que parte del dinero recaudado va para beneficios sociales

Comprobar Bonoloto: resultados ganadores del último sorteo de este miércoles 4 de marzo

Estos son los números premiados del sorteo de hoy. Aquí puedes comprobar si eres uno de los ganadores

La histórica casa de Jorge Cadaval de Los Morancos en Sevilla: un espacio colorido con unas vistas increíbles en el barrio de Triana

El cómico vive con su marido, el actor estadounidense Ken Appledorn, en un acogedor hogar decorado al milímetro

Un hijo es excluido del testamento de su padre y acude a los tribunales para reclamar su herencia: la jueza le da la razón y declara nula la clausula de desheredación

La sentencia permite a un hijo acceder a la legítima tras el allanamiento de los demandados y marca un precedente en la interpretación testamentaria

Flan de huevo y manzana: un postre dulce y fácil de hacer para sorprender a tus invitados esta primavera

Aprende paso a paso a preparar esta receta cremosa