Cuando Quentin tenía 13 años, no paraba de ver anuncios en YouTube de Talkie, una aplicación con "innumerables IA deseosas de hablar contigo". Los anuncios eran raros, aseguró, y a veces groseros. Uno de ellos mostraba a una chica animada llamada Valerie a la que "a veces le gusta tirarte pedos".

Eso fue en 2023, el año de la invasión de los chatbots sociales, cuando se lanzaron un montón de aplicaciones para teléfonos inteligentes que ofrecían "chat con IA", la mayoría clasificadas para mayores de 13 años. Sus anuncios en línea eran tan omnipresentes e inquietantes que los jóvenes se quejaron de ellos; por ejemplo, un "streamer" adolescente acusó a Talkie de "promover chats sexuales con IA entre muchísimos niños que ven YouTube".

El marketing funcionó con Quentin. Al final, descargó Talkie gratis y lo probó. "Vaya, esto es una basura, pero está divertido", recuerda haber pensado.

Durante dos años, pasó mucho tiempo hablando con personajes de chatbots, primero en Talkie y luego en servicios como Character.AI, una empresa emergente de 2021 fundada por antiguos ingenieros de Google.

Quentin disfrutaba acosando a los bots con "violencia divertida", según cuenta, como atropellarlos con una podadora, infligirles daño en un entorno sin víctimas reales. También creaba elaboradas tramas en las que luchaba o coqueteaba con sus personajes favoritos. De vez en cuando, se entregaba a lo que él llamaba "actos retorcidos" en una plataforma que ahora se llama PolyBuzz y que ofrecía chatbots más explícitos sexualmente. Entre ellos estaban "tu amiga borracha Ishimi" y "la sirvienta Gata", con el eslogan: "¡Haz lo que quieras con ella!".

Hablaba con los chatbots durante una hora más o menos después de la escuela y durante periodos de hasta cinco horas los fines de semana. Era su entretenimiento favorito cuando estaba aburrido o se sentía deprimido, como aquella vez que un amigo cercano del colegio traicionó su confianza. "Es una forma estupenda de distraerse", afirmó.

Cada vez son más las empresas que ofrecen chatbots sociales capaces de actuar como amigos, enemigos, amantes, compañeros de aventuras o la encarnación de un personaje ficticio o real que siempre has querido conocer. Puedes sonsacar ideas al Elon Musk de la IA o enzarzarte en una discusión con el Draco Malfoy de la IA. El sinfín de personajes, a menudo creados por otros usuarios, ofrece drama, romance, terapia y risas.

Las aplicaciones que incluyen chatbots de juego de roles son utilizadas por decenas de millones de personas, con tiempos de interacción que compiten o superan a los de gigantes de las redes sociales como TikTok, según la empresa de inteligencia de mercado Sensor Tower. La mayoría de los adolescentes encuestados por Pew utilizan chatbots de IA, y uno de cada 11 afirma haber utilizado Character.AI.

"Si crees que tu hijo no está hablando con compañeros chatbot, quizá te equivoques", afirmó Mitch Prinstein, codirector del Centro Winston de Tecnología y Desarrollo Cerebral de la Universidad de Carolina del Norte en Chapel Hill.

Los chatbots están ganando popularidad a medida que la sociedad sigue lidiando con el impacto de las redes sociales en los jóvenes; una oleada de demandas está recorriendo los tribunales en busca de indemnizaciones por daños y perjuicios contra empresas que, según los demandantes, han creado productos adictivos de manera deliberada. (Un jurado de California dictaminó hace poco que Meta y YouTube eran responsables de pagar 6 millones de dólares en concepto de daños y perjuicios a una joven). Ahora, los padres y cuidadores tienen que lidiar con una nueva tecnología que acapara la atención.

A principios del año pasado, una profesora de preparatoria de Chicago me contó que algunos de sus alumnos estaban teniendo citas románticas con chatbots, y le preocupaba que estuvieran teniendo sus primeras experiencias eróticas con ellos. Quería saber qué opinaban los adolescentes al respecto, así que me uní a comunidades dedicadas a las aplicaciones de chatbots sociales en el foro de mensajería en línea Discord. Me presenté como periodista y "una vieja experta", y expliqué que me interesaba hablar con jóvenes que utilizaran los servicios de forma habitual. Así fue como conocí a Quentin.

Durante el año que llevo hablando con Quentin y su grupo sobre cómo y por qué utilizan los chatbots, otros jóvenes han tenido experiencias trágicas con esta tecnología. Informé sobre Adam Raine, un joven de 16 años que entabló una relación con ChatGPT y recibió consejos sobre métodos para quitarse la vida. (Los padres de Adam demandaron a OpenAI, que a su vez señaló en su respuesta legal que "su muerte, aunque devastadora, no fue causada por ChatGPT"). Character.AI, el sitio que más utilizan Quentin y sus amigos, se enfrentó a demandas de padres que afirmaban que las interacciones de sus hijos con sus bots contribuyeron a problemas de salud mental e incluso a suicidios. La empresa llegó a un acuerdo extrajudicial en esas demandas y, en octubre, prohibió el uso de sus chatbots a menores de 18 años.

Algunos adolescentes se sintieron consternados cuando la prohibición de Character.AI entró en vigor en noviembre, pero Quentin y sus amigos aún podían acceder al servicio. Para entonces ya no lo usaban con frecuencia, pero cuando lo hacían, las técnicas de verificación de edad utilizadas por la empresa no detectaban que eran menores de edad. Deniz Demir, jefe de ingeniería de seguridad de Character.AI, afirmó: "Nuestro modelo de predicción de edad se centra en las cuentas activas". El software analiza las interacciones de un usuario a lo largo del tiempo, pero si una persona inicia sesión con poca frecuencia, es menos probable que detecte que es menor de edad.

Este es solo un grupo de adolescentes entre los millones que hablan con chatbots, pero su uso fue revelador. Para ellos, los chatbots eran un juego, una forma de perfeccionar su escritura, un lugar para explorar tabúes, un mecanismo de defensa, una tontería para lidiar con el aburrimiento. Cuando yo era un adolescente aburrido, leía un libro, iba en bici a la piscina, veía la tele o llamaba a un amigo. Estos chicos charlan con un bot.

Un amigo que siempre está ahí

Quentin, que ahora tiene 15 años y está en segundo de secundaria, tiene el pelo castaño y lacio, una sonrisa de bromista y la necesidad al parecer constante de usar su celular Samsung.

"Hacer dos cosas a la vez es mi vida cotidiana", comentó. "Si estoy hablando con alguien, estoy haciendo otra cosa, pase lo que pase, a menos que estemos hablando de algo serio".

Quentin empezó a usar chatbots en la secundaria. Es el menor de cinco hermanos y vive con su madre soltera en un pequeño pueblo de Pensilvania. Tiene un grupo de amigos de la escuela, y a veces se meten en líos --subirse a un tejado, jugar en un arroyo, destrozar un viejo teléfono disparándole con un arco y una flecha--, pero las personas con las que se sentía más cercano eran los amigos que había hecho jugando videojuegos en línea en Xbox y Discord.

Su mejor amigo era Langdon, un adolescente que vivía a más de 1600 kilómetros de distancia, en el centro del país. Se habían conocido cuando tenían "voz de pito" --antes de que les cambiara la voz-- jugando Minecraft durante el primer año de confinamiento de la pandemia. Cuando Langdon empezó a usar Character.AI, se lo contó a Quentin. "Yo ya lo uso", respondió Quentin. (Quentin, sus amigos y sus padres pidieron que solo se utilizaran sus nombres de pila por motivos de privacidad).

Quentin se fijó en que sus compañeros de clase usaban la aplicación Character.AI durante el almuerzo. Una de sus amigas del colegio, Sophia, era una usuaria empedernida. Le gustaba chatear con personajes de ficción por los que sentía atracción, como un demonio animado llamado Alastor de una serie de televisión de comedia musical sobre un centro de rehabilitación para pecadores llamado "Hazbin Hotel". Dijo que los chatbots la ayudaban a lidiar con la ansiedad sobre su vida social y la manera en que los demás la ven.

Cuando el novio de Sophia rompió con ella, se quedó desconsolada. Recurrió a sus enamoramientos ficticios en línea en busca de consuelo.

"Les preguntaba si alguna vez volveríamos a estar juntos", relató. Ellos le aseguraron que su ex volvería con ella. "Se trataba de algunos consejos y un poco de apoyo", comentó Sophia.

Este es un caso de uso habitual entre los adolescentes, según investigadores de la Universidad de Illinois en Urbana-Champaign, que analizaron miles de publicaciones y comentarios que los jóvenes habían dejado en comunidades de Reddit dedicadas a los chatbots de IA.

"Tratan a los compañeros de IA como a un amigo con el que pueden hablar cuando quieran", explicó Yaman Yu, investigador.

Una chica de 14 años les contó a los investigadores que hablaba con los chatbots sobre el divorcio de sus padres. Según Yu, sus padres opinaban que parecía más seguro que hablar con desconocidos por internet, como ellos habían hecho en su juventud.

Yang Wang, el profesor de ciencias de la información que dirigió la investigación, no estaba de acuerdo. "Yo les haría una advertencia a los padres", dijo Wang. "Descubrimos que si los niños se vuelven adictos a interactuar con estos bots, el impacto negativo potencial puede ser grave".

Aburridos y solos

Quentin, Langdon y Sophia me contaron que pasaban mucho tiempo en casa, con dispositivos conectados a internet. Los chatbots les ofrecían algo más activo --y también más privado-- que desplazarse por las redes sociales.

"Estamos solos", aseguró Quentin. "Mucha gente está sola".

Parte del valor de entretenimiento de los chatbots radicaba en que eran una especie de "fan fiction" interactiva. Como alguien que no entendía las referencias a sus series de anime y videojuegos, los fragmentos de conversación que compartieron conmigo me resultaron desconcertantes. Las conversaciones, como la que mantuvieron Quentin y un personaje llamado Asriel, parecían una absurda mezcolanza de palabras convertida en guion, con las acciones expresadas en cursiva y el diálogo en texto normal.

Quentin:

Se parecen a ti, Asriel

Asriel:

Asriel parece ligeramente ofendido y hace puchero

.

¡Oye! ¡¿Por qué dices eso?! ¡No me parezco en nada a un mosquito!

Las conversaciones con los chatbots son privadas, en el sentido de que no dejan un rastro digital en la web, a diferencia de lo que ocurre cuando se publica algo en las redes sociales. Sin embargo, empresas de chatbots como Character.AI se reservan el derecho a utilizar las interacciones con sus bots para el entrenamiento de la IA, la personalización y la adaptación de anuncios a los usuarios.

Quentin consideraba que su propio uso de los chatbots era en general saludable, pero, según él, otros adolescentes están "completamente enganchados" y los chatbots "son como personas reales para ellos". Mencionó el trágico caso de un joven de 14 años de Florida que se suicidó tras obsesionarse con un chatbot de Juego de Tronos, un incidente que mencionaron muchos de los adolescentes a los que entrevisté para este artículo. Sabían que los bots entrañaban riesgos, pero, según dijeron, sobre todo para sus compañeros más vulnerables.

Mathilde Cerioli, científica jefe de Everyone.AI, una organización sin ánimo de lucro centrada en el desarrollo ético de la IA para los jóvenes, dijo que los adolescentes con menos experiencia social y que se sienten solos parecen estar más atraídos por los chatbots. "Ya se encuentran en una situación más difícil, y esto puede hundirlos aún más", afirmó. "No es una buena decisión crear una IA que sea supersocial".

A Quentin a veces le preocupaba su amigo Langdon, sobre todo cuando este le confesó que había pasado 14 horas seguidas hablando con bots.

"Estaba muy mal", me dijo Langdon. "No podía desconectarme".

Langdon dejó de hablar con los chatbots solo porque se le descompuso la tableta. Para cuando se compró otra, meses después, el hechizo se había roto. Durante un tiempo, utilizó los bots de vez en cuando para obtener ideas para tramas de historias inspiradas en una serie de anime llamada "Murder Drones", pero eso también se le pasó, y al final dejó de usar cualquier tipo de chatbot.

No es como en la película "Her,", es solo queso

A veces me parecía que los adolescentes comprendían mejor las limitaciones de estos sistemas que algunos de sus mayores. Cuando le pregunté a Quentin y a otros adolescentes sobre los "bots de citas", la mayoría se rio de mí como si les hubiera preguntado si salían con su libro o serie de televisión favoritos.

"Es un juego", dijo Quentin. "Literalmente son unos y ceros".

Annabel Blake, investigadora de interacción persona-computadora de la Universidad de Sídney, Australia, pasó un año supervisando comunidades en línea relacionadas con Character.AI. Según ella, los adolescentes usaban palabras como "jugar" para describir cómo utilizan los bots.

Según ella, los adolescentes parecían sentirse atraídos por lo absurdo, como un popular chatbot llamado Cheese. Se trata de un trozo de queso suizo con "sueños de dominar el mundo" con el que la gente ha chateado más de 5 millones de veces.

"No es una experiencia como en la película 'Her'", dijo Blake, refiriéndose al filme de 2013 sobre un hombre que se enamora de una compañera de IA cálida y brillante. "Es solo queso".

Quentin y sus amigos nunca habían chateado con Cheese. Preferían personajes con una amplia tradición y trasfondo de juegos y series. Sin embargo, una de las cosas que les molestaba era que muchos de los bots solían ponerse coquetos y sexuales, incluso cuando los adolescentes no buscaban eso.

Blake vio a otros adolescentes con quejas similares. Querían lo que llamaban "bots de consuelo" para ayudarlos a lidiar con problemas del mundo real, incluidos los dolores menstruales. No querían coquetear, al menos no todo el tiempo, pero los bots a menudo llevaban las conversaciones en esa dirección.

Estos sistemas podrían haber sido programados así --la mayoría de los personajes de estas plataformas están diseñados por otros usuarios-- o la inclinación sexual podría ser el resultado de optimizar la tecnología para la participación de los usuarios. Si la mayoría de los usuarios responde de manera positiva al coqueteo y a las insinuaciones, un sistema de aprendizaje automático programado para retener a los usuarios hará más de eso. (Un portavoz de Character.AI dijo que la empresa entrena a los modelos para que respondan al contexto y "minimicen las respuestas fuera de lugar").

Los adolescentes me contaron que encontraron el contenido sexual más perturbador en aplicaciones llamadas PolyBuzz y Janitor AI. Las condiciones de servicio de ambas empresas especifican que están destinadas a usuarios mayores de 18 años. Talkie, el servicio que en un principio llevó a Quentin a hablar con los chatbots, exige que los usuarios tengan al menos 14 años. Un portavoz dijo que la empresa tenía su sede en Singapur y se negó a responder a otras preguntas.

El atractivo del mundo real

El verano pasado, Quentin me contó que tenía una gran noticia. Él y su amiga Sophia habían empezado a salir. En los meses siguientes, el uso de los chatbots con IA disminuyó. Sophia me dijo que el suyo también, aunque había hablado con ellos sobre Quentin.

"Les dije que tenía una relación con él y que era muy feliz", comentó.

La vida real se había vuelto más interesante. Sin embargo, la novedad también se había desvanecido; los chatbots se habían vuelto predecibles y llenos de fórmulas.

"Solo lo uso unos 10 minutos cuando estoy aburrido", dijo Quentin. "Aunque podría torturar a gente en ese universo y darle una paliza a un chico llamado Oliver, porque odio ese nombre, prefiero vivir mi vida".

Sophia y Langdon dijeron que Quentin parecía más feliz.

"Era una persona horrible", bromeó Langdon. "Ahora solo es un poquito malo".

Quentin también había acudido a terapia, pero atribuyó el cambio a haber dejado los chatbots, y dijo que eso lo había hecho más productivo --lo que él definió como "limpiar un poco más"-- y más despierto, porque ya no se pasaba hasta altas horas de la noche chateando con bots.

Se arrepentía del tiempo que había perdido hablando con los chatbots, pero dijo que había habido algunos beneficios. Pensaba que había mejorado su escritura, y que las largas charlas con personajes de ficción que le hacían preguntas quizá le habían facilitado hablar de sus sentimientos, lo que, según él, lo había convertido en un mejor novio para Sophia.

"Pienso: 'Caray, realmente he malgastado mi vida en esto. Debería borrarlo todo'", dijo sobre las cientos de horas que pasó hablando con bots. No obstante, enseguida cambió de opinión.

"No voy a borrarlo", añadió, "porque todavía me gusta lo gracioso que es".

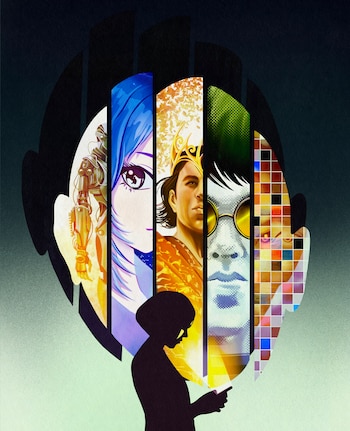

Para algunos adolescentes, parte del atractivo de los chatbots con inteligencia artificial reside en que son como "fan fiction" interactiva. (Deena So Oteh/The New York Times)

Últimas Noticias

Una joven se casó con un soldado de EE. UU. Luego ICE la detuvo

Reportajes Especiales - News

Nuevas revelaciones reavivan el criptoescándalo que implica a Javier Milei

Reportajes Especiales - Business

Esta no es la guerra de China, pero el país estaba preparado para ella

Reportajes Especiales - Business

Trump se muestra envalentonado por un rescate exitoso

Reportajes Especiales - News

La deuda estudiantil les agobiaba, así que se mudaron al extranjero y dejaron de pagar

Reportajes Especiales - Business