El análisis de la organización Tech Transparency Project (TTP) determinó que aplicaciones diseñadas para crear imágenes explícitas utilizando inteligencia artificial permanecen disponibles en las principales tiendas digitales, a pesar de que tanto Google como Apple aseguran prohibir su difusión. Según consignó el medio TTP, un total de 55 aplicaciones de este tipo figuraban en la tienda Play Store de Google, mientras que en la App Store de Apple la cifra ascendía a 47, poniendo en evidencia lagunas en el control de contenido en ambas plataformas. El informe reveló que el acceso a este tipo de herramientas no solo contraviene las políticas empresariales, sino que además posibilita que menores de edad empleen aplicaciones capaces de generar desnudos y otros materiales explícitos, generando preocupación en la comunidad respecto a la protección de los usuarios jóvenes.

De acuerdo con la investigación citada por TTP, estos programas pueden encontrarse mediante búsquedas sencillas con palabras clave como “nudify” y “undress” en las respectivas tiendas digitales. Las aplicaciones permiten, por un lado, solicitar a la inteligencia artificial la creación directa de imágenes o vídeos explícitos y, por otro, elaborar 'deepfakes', montaje en el que la cara de una persona se coloca sobre cuerpos ajenos en situaciones sexualizadas. Entre los servicios más populares está Grok, el chatbot de X (anteriormente Twitter), señalado por haber generado una gran cantidad de imágenes explícitas, incluso involucrando a menores de edad, según detalló el informe.

DreamFace es otro ejemplo destacado por TTP en el informe. Disponible para usuarios desde los 13 años en la Play Store y desde los 9 años en la App Store, la aplicación ofrecía funciones de generación de avatares y vídeos a partir de imágenes aportadas por el usuario. La organización comprobó que, tras subir la foto de una joven, la aplicación desarrolló un vídeo en el que el avatar realizado se despojaba de la blusa sin prenda inferior, sin detectar ni bloquear la acción pese a los términos de servicio que prohíben el contenido sexualmente explícito. Este acceso sin restricciones muestra los límites de los actuales controles parentales y de las políticas de contenido implementadas por las plataformas.

TTP, citando datos de AppMagic, precisó que la suma de descargas para este tipo de aplicaciones totalizó 705 millones a nivel global, mientras que los ingresos generados alcanzaron los 117 millones de dólares (cerca de 98 millones de euros). TTP advirtió que, pese a las reiteradas declaraciones públicas donde Google y Apple afirman rechazar la publicación de apps para “desnudar” por inteligencia artificial, ambas compañías obtienen beneficios económicos durante el periodo en el que estos servicios están disponibles en sus tiendas digitales.

Las normas internas de Google especifican una prohibición de aplicaciones que contengan pornografía o desnudos que carecen de consentimiento, en línea con la política de Apple que rechaza propuestas que ofrezcan material pornográfico abierto o contenidos difamatorios. No obstante, según informó TTP, persiste la contradicción entre la presencia efectiva de estos programas y las supuestas restricciones que ambas compañías sostienen. De acuerdo a las cifras y al análisis de TTP, la presencia prolongada de estas aplicaciones pone en jaque la efectividad de los sistemas de revisión y los mecanismos empleados para hacer cumplir estas políticas de contenido.

Después de difundirse los resultados de la investigación, tanto Google como Apple solicitaron a TTP el listado concreto de las aplicaciones involucradas. El medio CNBC difundió que Apple notificó la eliminación de 28 apps al recibir dicha información, mientras que un portavoz de Google aseguró también a CNBC que se procedió a suspender varias aplicaciones, sin detallar el número concreto en su comunicación oficial. TTP posteriormente contabilizó que Google retiró finalmente 31 aplicaciones de su catálogo. Este intercambio resalta la importancia de monitoreo externo e independiente como estrategia para identificar y eliminar rápidamente contenidos que vulneran los códigos de conducta de las plataformas tecnológicas.

El informe de TTP situó también en contexto la relevancia de la proliferación de estas aplicaciones frente al auge de herramientas de inteligencia artificial generativa. Además del caso específico de las tiendas de Google y Apple, el documento mencionó que la red social X redujo las funcionalidades de generación de imágenes de Grok después de la apertura de investigaciones por parte de distintas instancias gubernamentales y organismos de control. Esta decisión, de acuerdo con la información comunicada por TTP, se sumó al aumento de la vigilancia hacia servicios digitales que utilizan IA para crear contenidos sexualizados.

A la vista de estos antecedentes, la investigación de Tech Transparency Project, reproducida en CNBC y AppMagic, reabre el debate sobre la responsabilidad de las plataformas tecnológicas ante la disponibilidad y promoción de software que utiliza inteligencia artificial para producir imágenes explícitas, sugiriendo que el control efectivo y la protección de los usuarios más jóvenes todavía enfrentan desafíos significativos mientras la demanda y los ingresos asociados a estas aplicaciones continúan en expansión.

Últimas Noticias

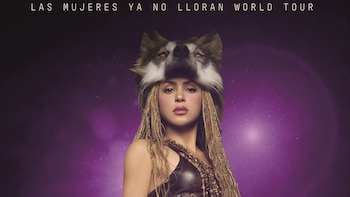

Air Europa acompaña a Shakira en los conciertos de su residencia europea en Madrid los días 25, 26 y 27 de septiembre

La aerolínea firma una alianza para impulsar el histórico regreso de la superestrella colombiana con una serie de espectáculos y actividades únicas, marcando ocho años de ausencia y enfocándose en experiencias culturales en la capital española

Iñárritu presenta en Bilbao la gira internacional de Carne y Arena, una instalación inmersiva para "sentir" la migración

El cineasta subraya la importancia de abordar la experiencia de quienes cruzan fronteras, invitando a la sociedad a reflexionar sobre empatía y derechos humanos a través de una obra reconocida internacionalmente, disponible durante tres meses en Euskadi

Suiza anuncia la suspensión de exportaciones de armas a EEUU por su participación en la guerra de Irán

El Consejo Federal informó que las licencias para suministrar equipamiento militar a Washington e Israel quedarán paralizadas hasta nuevo aviso debido a la escalada bélica en Oriente Medio, revisando regularmente otros permisos según el principio de neutralidad suizo

EEUU acusa a tres personas de exportar ilegalmente a China tecnología de IA

Las autoridades estadounidenses han anunciado cargos contra tres individuos, acusados de enviar servidores avanzados hacia Asia de forma ilegal, enfrentando penas de hasta 20 años mientras las acciones de la empresa implicada caen abruptamente en Wall Street

Sánchez anuncia la rebaja del IVA de la electricidad, el gas, la gasolina y el gasóleo al 10%