Si Pablo Katchadjian engordó El Aleph de Borges, podría decirse que Juan Manuel Lara lo recortó y diseccionó para experimentar con las nuevas herramientas de inteligencia artificial (IA) y su capacidad supuestamente ilimitada para generar imágenes online. Lara trabajó con el programa Dall E 2, el cual “aparece en pantalla como si se tratara de un buscador, con una ‘caja’ o espacio en blanco donde se introduce una descripción de la imagen que se quiere obtener”–explica–. Así hizo Aleph 2, un libro de imágenes.

A través de este procedimiento aparentemente simple Lara -un artista nacido en ciudad argentina de La Plata en 1988-, tomó del cuento de Borges el fragmento en que el narrador describe sus visiones y las fue transcribiendo, “de a una por cada Enter”.

Escribe Borges: Vi el populoso mar, vi el alba y la tarde, vi las muchedumbres de América, vi una plateada telaraña en el centro de una negra pirámide, vi un laberinto roto (era Londres), vi interminables ojos inmediatos escrutándose en mí como en un espejo, vi todos los espejos del planeta y ninguno me reflejó, vi en un traspatio de la calle Soler las mismas baldosas que hace treinta años (...) vi mi cara y mis vísceras, vi tu cara, y sentí vértigo y lloré, porque mis ojos habían visto ese objeto secreto y conjetural, cuyo nombre usurpan los hombres, pero que ningún hombre ha mirado: el inconcebible universo.”

Así buscó: “el populoso mar”, “el alba y la tarde”, “las muchedumbres de América”, etc., solo que, para un funcionamiento correcto del programa, debió recurrir a una traducción al inglés.

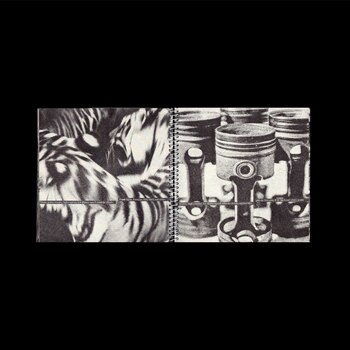

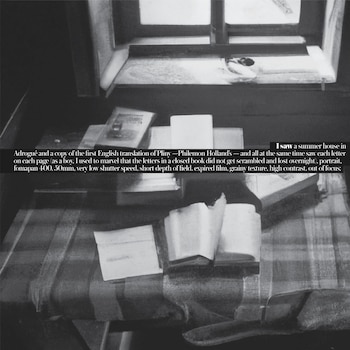

A ese enunciado le agregó los detalles formales para determinar cómo quería que se viera la imagen resultante, denominada “sintografía” por su origen “sintético”. En este punto, el artista decidió orientar su “búsqueda” hacia una visualidad vinculada a la fotografía, por lo que sumó especificaciones técnicas que abarcaban desde la película y el tipo de cámara hasta la escala de colores, la textura y el encuadre, por ejemplo: “Tigers, fomapan 400, black and white, 50 mm, grainy texture, high contrast, low shutter speed, intricate details” (“Tigres, fomapan 400, blanco y negro, 50 mm, textura granulada, alto contraste, baja velocidad de obturación, detalles intrincados”).

Si bien el programa tiene la capacidad de generar infinitas imágenes a partir de cada una de las descripciones y de las especificaciones técnicas que agregó Lara –engordando, en este sentido, al original–, el artista y el editor del libro, Martín Bollati, han seleccionado una sola sintografía por visión para integrar Aleph2. Cada una ocupa una página y se imprime junto a las indicaciones textuales que le dieron origen, conservando a su vez el orden en que Borges las fue enumerando en el cuento. El resultado tiene la apariencia de un conjunto de fotografías de grano grueso y baja nitidez, como si cada imagen fija estuviera tomada de un flujo de visiones en constante transformación.

-¿Por qué decidiste elegir las visiones de El Aleph?

-Son imágenes muy claras, cercanas al cine o a la fotografía, pero también quería ver cómo reaccionaba el programa ante un texto con una constitución literaria, donde lo poético estuviera muy presente. Por ejemplo, “Vi un poniente en Querétaro que parecía reflejar el color de una rosa en Bengala”: quería ver cómo procesaba eso la inteligencia artificial, cómo se vinculaba lo literario con lo tecnológico, ese choque fue una de las cosas que motorizó esta búsqueda. Tal es así, que en castellano no pudo procesarlas, no daba fotos, lo tuve que hacer en inglés.

-¿Cómo fue el proceso de construcción de las imágenes?

-Arranco desde el cuento y con una única apelación a la fotografía, que fuera “analógica” o “blanco y negro”. Pero después, conforme fue avanzando el proceso, tuve que agregar tipos de lentes, películas, apertura de diafragma y las características del encuadre. Tuve que echar mano al conocimiento teórico y práctico sobre la fotografía que aprendí sacando fotos, usando cámaras. Otro camino podría haber sido montarme en el estilo de algún fotógrafo y que eso incluyera todas estas decisiones. Pero elegí ir trabajando imagen por imagen, según lo que me devolvía y lo que yo precisaba para completar el libro.

-¿Pero elegir el estilo de alguien en particular hubiera significado cruzar el trabajo de un artista de la fotografía con el de un escritor, Borges?

-Sí. De todos modos, con Dall E 2 hay distintos tipos de búsqueda: ilustración digital, pintura impresionista, depende. A mí me interesaba la imagen fotográfica y los resultados en cuanto a verosimilitud y acercamiento a una idea de fotografía con un referente real, a ese verosímil. Los resultados eran bastante asombrosos porque obtuve imágenes muy cercanas, obtenía un resultado muy satisfactorio y más.

-¿Una fotografía como vos te imaginabas o incluso mejor en el sentido de que respondía a tus indicaciones e incluso superaba tus expectativas?

-A lo que mejor respondía a las indicaciones técnicas o formales, no tanto al objeto en sí, al referente. Por ejemplo, si buscaba un retrato de una persona, esa “persona en sí” era una sorpresa total, pero yo estaba más conectado a lo accesorio, que en realidad es igual de importante.

-Vos en el libro incluís estas indicaciones “accesorias” a continuación de la visión de Borges, como si formaran parte del referente o del epígrafe de la imagen. Entonces, en tu jerarquía de importancia…

Están al mismo nivel. Es muy evidente, después, qué parte es de Borges y cuáles son las características técnicas de la imagen, pero en el libro forman parte de la misma frase. También surgen preguntas: ¿De dónde salió esta cara que es tan humana y a la vez no? Hasta ahora, siempre pude notar algún ruido en la imagen, sobre todo en los retratos, que te hace ver que eso no es humano porque salta en algún detalle. Por ejemplo en el retrato de la página 8, que me gusta mucho, se puede ver en las pupilas. Pero en algunos casos, mi objetivo de máxima era que, si yo no agregaba información de contexto, no te dieras cuenta que se trataba de una imagen generada con este tipo de programas, como un juego de trucos y engaños. Este fue el objetivo inicial en la búsqueda.

-¿Por qué buscabas eso?

-Lo buscaba porque me movió la fascinación de encontrar imágenes “a demanda”. Pero, en retrospectiva, te puedo decir que es un trabajo de reflexión y de práctica sobre la fotografía misma: porque si bien el resultante de este proceso no es una fotografía, sí está apelando a ese universo; está dialogando con la convención de cómo vemos o qué entendemos por fotografía. Y yo, por otro camino, por el camino del texto, fui tratando de llegar a un punto en el que confluyera la imagen que me daba el programa con la de la convención fotográfica, entendiendo qué elementos constituyen una fotografía.

-¿Y por qué modificaste el estilo fotográfico de las imágenes?

-Cuando después empezamos a trabajar con el libro, fuimos encontrando el tono, que se fue apartando de ese verosímil fotográfico y terminamos con imágenes más abstractas: incorporamos estas “letras”, más allá de que sean legibles o no; incorporamos también fotografía médica y fotografía astronómica.

Además, a medida que íbamos ampliando el cuerpo de imágenes y que ya teníamos listas algunas partes del libro, necesitábamos que las siguientes mantuvieran cierta coherencia con el grupo.

-¿Por ejemplo?

-En ese dúo en las páginas 8 y 9: “Vi interminables ojos inmediatos escrutándose en mí como en un espejo, vi todos los espejos del planeta y ninguno me reflejó”: nos costó mucho encontrar esta segunda imagen. Por eso nos tomamos ahí una licencia de agregar más indicaciones, como por ejemplo: “Cientos de espejos…”. El programa respondía casi inmediatamente y muy bien a algunos comandos, pero en otros casos hubo que seguir incorporando texto y características técnicas.

-¿Como “engordando” El Aleph?

-Hay dos o tres imágenes en que está engordado.

-Si bien la IA, por sus billones de posibilidades de generar distintas imágenes, te acerca a la idea de infinito, siempre también, al editar, estás recortando. ¿En ese procedimiento se genera entonces una paradoja entre lo infinito y lo limitado?

-Si uno quisiera, podría darle Enter infinitas veces a la misma indicación y obtener infinitas imágenes diferentes. Sin embargo, nosotros elegimos quedarnos con una. Es como el disparador para pensar cuestiones que tienen que ver con la representación, con el lenguaje en sí, con cómo circulan las imágenes en internet y nuestros preconceptos sobre todo eso. Como dice ahí, es un número cercano al infinito porque la cantidad escapa a una escala que podamos manejar.

-Pero eso también es una paradoja: es casi infinito para nosotros, pero para una máquina no es inabarcable.

-Y ahí está la cuestión de que en internet no están todas las imágenes del mundo. Hay una jerarquía, un sistema, una categorización, etiquetas, ideología, obviamente. Es una manera de descubrir eso, de quitar ese velo y de entender que se trata de un número muy grande que escapa a una escala humana y que justamente por eso lo procesa una IA. De todos modos, en el inicio, en el orden, está lo humano: en los comandos que se le dan al programa para que reconozca, asocie, que son indicaciones muy claras. Por ejemplo, a mí, en español, no me permitía indicar el color “negro”; el término inmediatamente hacía saltar un alerta por impropiedad porque en inglés es ofensivo.

-Entonces ahí surgen los límites establecidos por seres humanos, pero aplicados por máquinas.

-Es también un acercamiento al desborde de imágenes. En el cuento, Borges dice que tiene que verlo todo y por eso tiene que ver también lo atroz. Y hay personas que trabajan para las empresas de IA que tienen que ver todo también para clasificar los contenidos en base a determinados parámetros. Estas personas seleccionan el material que formará parte del universo que después la IA va a reconocer, con el que va a trabajar. Lo demás queda afuera.

-¿Te imaginás que habrá cambios en las próximas etapas?

-No sé, pero como usuario de redes sociales, por ejemplo, puedo decir que no ha habido muchos cambios respecto al desnudo y al desnudo femenino particularmente. En ese caso se trata de otro tipo de tecnología, pero por sí misma no va a hacer discernimientos cuando entra en juego la moral, lo políticamente correcto, lo condenable, hasta lo legal, sobre todo los derechos de autor, la noción de autoría, un debate bastante abierto.

-Volviendo a la IA, ¿la generación de las imágenes es online solamente o podés usar el mismo programa en una computadora sin conexión a internet?

-Yo creo que se puede hacer eso, pero tenés que proveer al programa de la base de imágenes para que se entrene. En el caso de Dall E 2, el modelo se entrenó inicialmente en una gran cantidad de datos de imágenes etiquetadas de la plataforma de intercambio de imágenes ImageNet, que consta de más de 14 millones de imágenes de alta resolución, divididas en más de 21 mil categorías diferentes.

-Al hacerlo online, ya contás con esa base. ¿Son fotos de usuarios?

-Dicen que no debería ser así, pero entiendo también que hay imágenes de Pinterest o de otros bancos y ahí ya surge una cuestión engorrosa desde lo legal y lo ético también. Como es súper reciente, lo tiene que definir la Corte Suprema de Estados Unidos porque hay artistas que vieron dibujos suyos o formas muy similares. Hay algo nuevo que es el robo del estilo, que no se corresponde exactamente con la noción de plagio que hemos manejado durante la Modernidad. Es decir, cuando no es una reproducción exacta de algo que hiciste, pero es tu estilo muy claramente, ¿eso qué es?

-El blanco y negro pareciera darle una apariencia atemporal al trabajo. Sin embargo, ¿podrías haber elegido cualquier otro estilo de fotografía?

-Sí. Hay algo personal, por un lado, yo solo había trabajado en blanco y negro. Por el otro, hay una estética que va hacia ahí en los títulos quien editó el libro. Pero también nos preguntábamos qué tipo de imagen vio el personaje de Borges en El Aleph. ¿Vio HD? ¿Qué pasó una vez que tuvo esa epifanía –porque él después va olvidando– y cómo es el recuerdo de eso que vio? Nos pareció que iba por el lado de una experiencia de imagen más difusa.

El libro está impreso en risografía, que genera a la vez más grano y también rompe un poco el borde de la forma. Entonces quisimos acentuar lo esfumado, provocando una imagen más volátil, en que el concepto de memoria está muy presente. Nos preguntamos también cómo fue el acercamiento a ese objeto. Verlo todo es algo milagroso, es una experiencia, ¿qué imagen podía llegar a evocar eso? Fuimos a la búsqueda de algo que no fuera tan preciso ni tan definido.

* “El Aleph 2″ se puede encargar por Internet a la editorial SED: https://sededitorial.com.ar.

Seguir leyendo

Últimas Noticias

Adiós a Mario Vargas Llosa, ese enorme novelista que nunca callaba lo que pensaba

La noticia fue confirmada por su hijo Álvaro a través de la red X. Dijo que fue en Lima, rodeado por su familia y en paz. Anunció también que será incinerado. El Premio Nobel peruano tenía 89 años

Otro Álvaro Pombo, un país que ardía: el último libro del ganador del Premio Cervantes cuenta recuerdos de la Guerra Civil Española

El personaje principal de “Santander, 1936″, es el tío del escritor, que en ese entonces acababa de volver de Francia. Agitación política y sus consecuencias

“Un país bañado en sangre”: Paul Auster advirtió sobre el peligro de las armas libres en Estados Unidos más de un año antes del atentado a Trump

El autor contando que su abuela mató a su abuelo de un tiro. Pero el libro, que tiene menos de cien páginas, va mucho más profundo. Allí el autor, que murió en mayo, dice que los norteamericanos tienen veinticinco veces más posibilidades de recibir un balazo que los ciudadanos de otros países ricos

Moisés Naim: “Hoy la democracia está bajo ataque a nivel mundial, es una forma de gobierno en peligro de extinción”

El columnista venezolano, uno de los más leídos en castellano, publica un nuevo libro, “Lo que nos está pasando”. Habló con Infobae sobre sus temas principales: las nuevas estrategias dictatoriales, el rematch electoral entre Joe Biden y Donald Trump, el combo del populismo, la polarización y la posverdad y la sensación generalizada de vivir un periodo de crisis histórica

Así son los jóvenes escritores de Lisboa que llegarán a Buenos Aires: fútbol, diversidad y mestizaje

Yara Nakahanda Monteiro, Bruno Vieira Amaral y Afonso Reis Cabral estarán en la Feria del Libro porteña. Aquí comparten expectativas sobre su encuentro con autores y editores argentinos