Os desenvolvedores do Google estão ensinando inteligência artificial a explicar piadas, algo que longe de ser banal pode potencializar um profundo avanço tecnológico na forma como esses sistemas conseguem aprender automaticamente a analisar e responder à linguagem humana.

O objetivo é ultrapassar as fronteiras da tecnologia de Processamento de Linguagem Natural (PNL), que é usada para grandes modelos de linguagem (LLMs) como o GPT-30 que permitem, por exemplo, que os chatbots reproduzam uma comunicação humana cada vez mais precisa, o que, nos casos mais avançados, dificulta distinguir se o interlocutor é um ser humano ou uma máquina.

Agora, em um artigo publicado recentemente, a equipe de pesquisa do Google afirma ter treinado um modelo de linguagem chamado PalM que é capaz não só de gerar texto realista, mas também de interpretar e explicar piadas contadas por humanos.

Nos exemplos que acompanham o documento, a equipe de inteligência artificial do Google demonstra a capacidade do modelo de realizar raciocínio lógico e outras tarefas de linguagem complexas que são altamente dependentes do contexto, por exemplo, usando uma técnica chamada indicação da cadeia de pensamento, que muito melhora a capacidade do sistema de analisar problemas lógicos em várias etapas, simulando o processo de pensamento de um ser humano.

Ao “explicar as piadas”, o sistema mostra que entende a piada, e você pode encontrar o truque da trama, o jogo de palavras ou a saída sarcástica na piada da piada, como pode ser visto neste exemplo.

Piada: Qual é a diferença entre uma zebra e um guarda-chuva? Um é um animal listrado relacionado a cavalos, outro é um dispositivo que você usa para evitar que a chuva caia sobre você.

Explicação da IA: Essa piada é anti-piada. A piada é que a resposta é óbvia, e a piada é que você esperava uma resposta engraçada.

Por trás da capacidade do PalM de analisar essas indicações está um dos maiores modelos de linguagem já construídos, com 540 bilhões de parâmetros. Parâmetros são os elementos do modelo que são treinados durante o processo de aprendizagem cada vez que o sistema recebe dados de amostra. O antecessor do PalM, o GPT-3, tem 175 bilhões de parâmetros.

O número crescente de parâmetros permitiu que os pesquisadores produzissem uma ampla gama de resultados de alta qualidade sem a necessidade de gastar tempo treinando o modelo para cenários individuais. Em outras palavras, o desempenho de um modelo de linguagem é frequentemente medido pelo número de parâmetros que ele suporta, com modelos maiores capazes do que é conhecido como “aprender com poucas tentativas”, ou a capacidade de um sistema de aprender uma ampla variedade de tarefas complexas com relativamente poucos exemplos de treinamento.

CONTINUE LENDO

Más Noticias

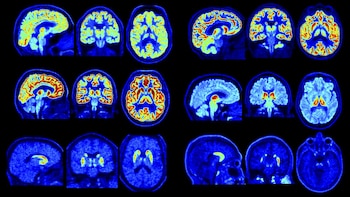

Nuevo escáner PET permite detectar trastornos cerebrales con mayor precisión y antelación

La nueva tecnología desarrollada en Yale ofrece imágenes más nítidas y detalladas, lo que abre posibilidades inéditas para identificar alteraciones neurológicas en fases iniciales y avanzar en la investigación clínica

Comprobar Super Once: los resultados ganadores del Sorteo 3 de este 20 diciembre

Con las loterías de Juegos Once no sólo tienes la oportunidad de ganar millones de euros en premios, sino que parte del dinero recaudado va para beneficios sociales

Precio de la luz en España para el domingo 21 de diciembre: cuáles serán las horas más económicas

El contexto económico internacional ha provocado un aumento histórico en los precios de la energía eléctrica en el país

Carlos Valderrama habló sobre la esperanza que tiene con la selección Colombia en el Mundial 2026: “Tienen personalidad”

El “Mono” habló en la previa del partido de despedida del partido de Mario Alberto Yepes sobre sus expectativas con la “Tricolor”

Detonaron un cilindro bomba en vía Cali-Buenaventura

Las autoridades mantienen la investigación para identificar a los responsables del hecho. Se recomienda a los conductores mantenerse informados y no difundir rumores hasta que se entreguen más detalles