Las imágenes generadas por IA alcanzan un nivel de realismo sin precedentes, resultando casi indistinguibles de las fotografías auténticas. Expertos sostienen que discernir entre los rostros creados artificialmente y los reales es ahora más desafiante, afectado por sesgos tanto humanos como de los propios algoritmos.

Un estudio reciente publicado en la revista Psychological Science revela que individuos pueden confundir con mayor probabilidad rostros blancos generados por inteligencia artificial (IA) con rostros reales, comparado con la identificación de verdaderas fotografías de personas blancas. Este fenómeno resalta una dificultad específica para discernir entre imágenes auténticas y las creadas por tecnología avanzada.

PUBLICIDAD

En una colaboración internacional de investigadores provenientes de universidades en Australia, los Países Bajos y el Reino Unido, se diseñó un experimento que involucró a 124 adultos blancos. A estos se les encomendó la tarea de identificar si una serie de rostros eran reales o artificiales y, acto seguido, debían asignar una puntuación a su nivel de certeza respecto a cada elección, utilizando una escala de 100 puntos.

Los organizadores del estudio optaron por mostrar a los participantes imágenes de rostros caucásicos para limitar el efecto del “sesgo de reconocimiento de la propia raza” que describe la tendencia de individuos de determinados grupos étnicos y culturales a recordar con menos eficacia las caras de personas que pertenecen a otros grupos demográficos.

PUBLICIDAD

“Sorprendentemente, los rostros blancos de la IA pueden pasar de manera convincente como más reales que los rostros humanos, y las personas no se dan cuenta de que están siendo engañadas”, explicaron los investigadores en su artículo.

Los participantes clasificaron erróneamente un 66 por ciento de las imágenes de IA como humanos fotografiados, frente a apenas la mitad de las fotos reales. Mientras tanto, la capacidad de los mismos participantes blancos para discernir entre personas de color reales y artificiales era aproximadamente de 50-50.

PUBLICIDAD

En un segundo experimento, 610 participantes calificaron las mismas imágenes usando 14 atributos que contribuían a lo que las hacía parecer humanas, sin saber que algunas fotos eran falsas. De esos atributos, la proporcionalidad de los rostros, la familiaridad, la memorabilidad y la percepción de ojos realistas ocuparon los primeros lugares para los sujetos de prueba.

El equipo denominó esta tendencia recién identificada de atribuir excesivamente erróneamente los rostros generados artificialmente (específicamente, los rostros blancos) como “hiperrealismo de la IA”.

PUBLICIDAD

Las significativas discrepancias estadísticas observadas se atribuyen a los sesgos algorítmicos conocidos que surgen en el desarrollo de la inteligencia artificial. Los sistemas de IA suelen ser entrenados con un número más elevado de sujetos blancos en comparación con personas de color (POC).

Esta práctica resulta en una mayor eficacia de la IA a la hora de crear rostros blancos creíbles, así como en su capacidad para reconocerlos con precisión a través de técnicas de reconocimiento facial.

PUBLICIDAD

Esta disparidad tiene implicaciones que pueden extenderse a múltiples ámbitos, incluyendo situaciones científicas, sociales y psicológicas. Los efectos podrían manifestarse en escenarios diversos que van desde el robo de identidad y reconocimiento facial, sin olvidar las preocupaciones fundamentales relacionadas con la privacidad.

“Nuestros resultados explican por qué ocurre el hiperrealismo de la IA y muestran que no todas las caras de la IA parecen igualmente realistas, con implicaciones para la proliferación de prejuicios sociales y para la identificación pública errónea de la IA”, escribió el equipo en su artículo.

PUBLICIDAD

Es importante mencionar que la muestra utilizada en el estudio reciente fue reducida y bastante restringida en cuanto a su diversidad, lo que subraya la necesidad de investigaciones más amplias para una comprensión cabal del impacto y la magnitud de estos sesgos.

A pesar de estas limitaciones, persiste la realidad de que aún se desconoce mucho respecto a las consecuencias que el hiperrealismo de la inteligencia artificial podría tener en las poblaciones y en el juicio en la cotidianidad.

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

Últimas Noticias

Asistentes de voz y chatbots pueden ser manipulados con sonidos invisibles para el oído humano

La técnica, bautizada como AudioHijack, muestra que bastan apenas 30 minutos de entrenamiento para crear una señal utilizable en cualquier contexto

Cuatro consejos para evitar que el cargador de tu celular se caliente demasiado

El uso constante de la carga rápida puede elevar la temperatura y acelerar el desgaste de la batería

Cómo funciona el sistema con IA que logra hasta un 99% de precisión en diagnosticar enfermedades cardíacas

El modelo CMR-CLIP, desarrollado por la Cleveland Clinic y la Universidad Carnegie Mellon, integra imágenes del corazón con informes clínicos y supera en más de un 35% a los modelos previos en diversas pruebas

Exempleado de Meta describe los despidos internos como un episodio de ‘El juego del calamar’

El testimonio surgió tras la notificación abrupta de la desvinculación de miles de empleados, mientras la empresa redirige su estrategia hacia la IA

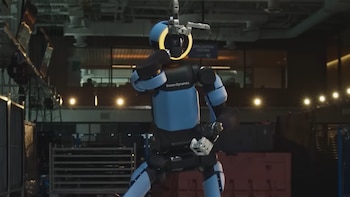

Este robot ya entrena fútbol, celebra como Griezmann y quiere ir a la Copa Mundial FIFA 2026

El dispositivo cuenta con capacidad de hacer amagues y diferentes rutinas de entrenamiento